Wer heute in einer AI-Antwort als Quelle auftaucht, kann nächste Woche schon wieder verschwunden sein. Unsere Analyse von 82.619 Prompts über 17 Wochen zeigt: Google tauscht in AI Mode-Antworten wöchentlich 56% der Quellen aus, ChatGPT sogar 74%. Wer bleibt, wer verschwindet, und warum es problematisch ist, dass die drei großen Plattformen eigentlich kaum etwas gemeinsam haben.

- Die 5 wichtigsten Erkenntnisse

- Drei Plattformen, drei Citation-Architekturen

- Google AI Overviews: der geschlossene Kreis

- Google AI Mode: wenige bleiben, viele wechseln

- ChatGPT Search: totale Fluktuation

- Die Marken-Domain bleibt, der Rest rotiert

- Welche Domain-Typen überleben den Citation Drift?

- Google AI Mode: klare Hierarchie

- ChatGPT: keine klare Hierarchie

- Was überlebt? Die URL-Klassifikation

- Jede Plattform zitiert andere Quellen

- Domain-Level vs. URL-Level: unsere Zahlen sind konservativ

- Citation Drift ist global

- Was bedeutet das für GEO?

- Datengrundlage

Unter dem Begriff „AI Citation Drift“ wird seit Mitte 2025 diskutiert, wie stabil AI-Quellenverweise („Citations„) überhaupt sind. Angestoßen durch eine Profound-Studie mit Fokus auf dem monatlichen Drift im US-Markt. Wir haben uns das Thema mit SISTRIX-Daten etwas genauer angeschaut, über drei Plattformen, sechs Länder und 17 Wochen hinweg.

Die 5 wichtigsten Erkenntnisse

- Jede AI-Mode-Antwort hat einen festen Kern und ein Karussell. Bei 86% aller Prompts gibt es einen stabilen Kern aus wenigen Domains, der Rest rotiert zu 89% pro Woche. Die Frage bei GEO ist also nicht „bin ich in der Antwort“, sondern „bin ich im Kern oder im Karussell“.

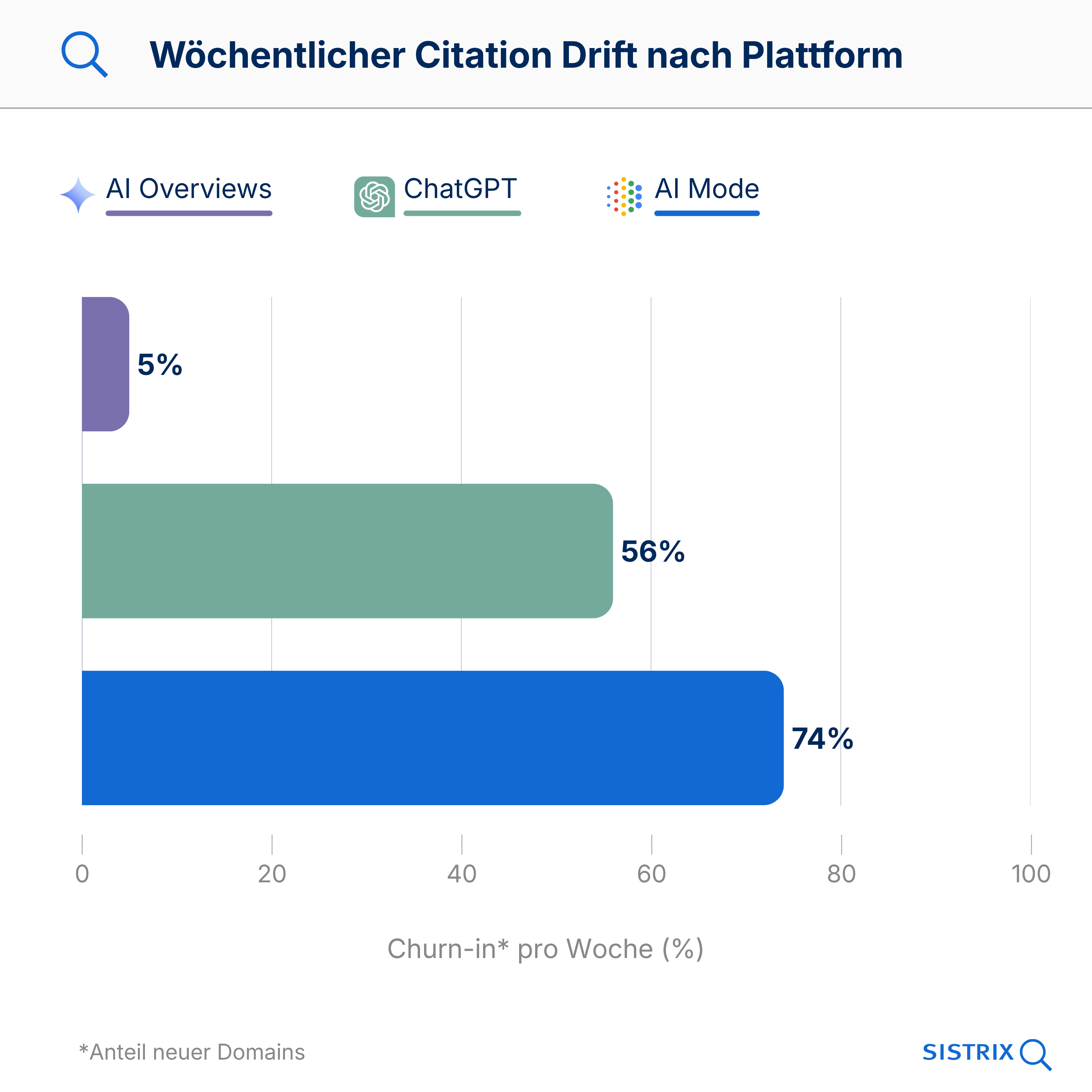

- Drei Plattformen, drei Architekturen. AI Overviews sind bei gut der Hälfte der Queries komplett stabil, AI Mode-Antworten rotieren zu 56% pro Woche, bei ChatGPT zu 74%. Die Plattformen in einen Topf zu werfen, verwischt mehr als es zeigt.

- Brand-Domains sind verankert. Bei 43% der Marken-Queries ist die eigene Domain in allen 17 Wochen präsent, die Co-Citations daneben rotieren zu 70% pro Woche. Wer eine Marke ist, bleibt zitiert. Wer neben der Marke steht, wird nächste Woche durch eine andere Seite ersetzt.

- News sind ein Einwegticket. Nur 1,4% der Nachrichtenartikel, die als Quelle zitiert werden, bleiben dauerhaft im Citation-Set. Wer die eigene Citation-Strategie über redaktionelle Nachrichteninhalte plant, plant falsch. Evergreen-Content überlebt systematisch besser.

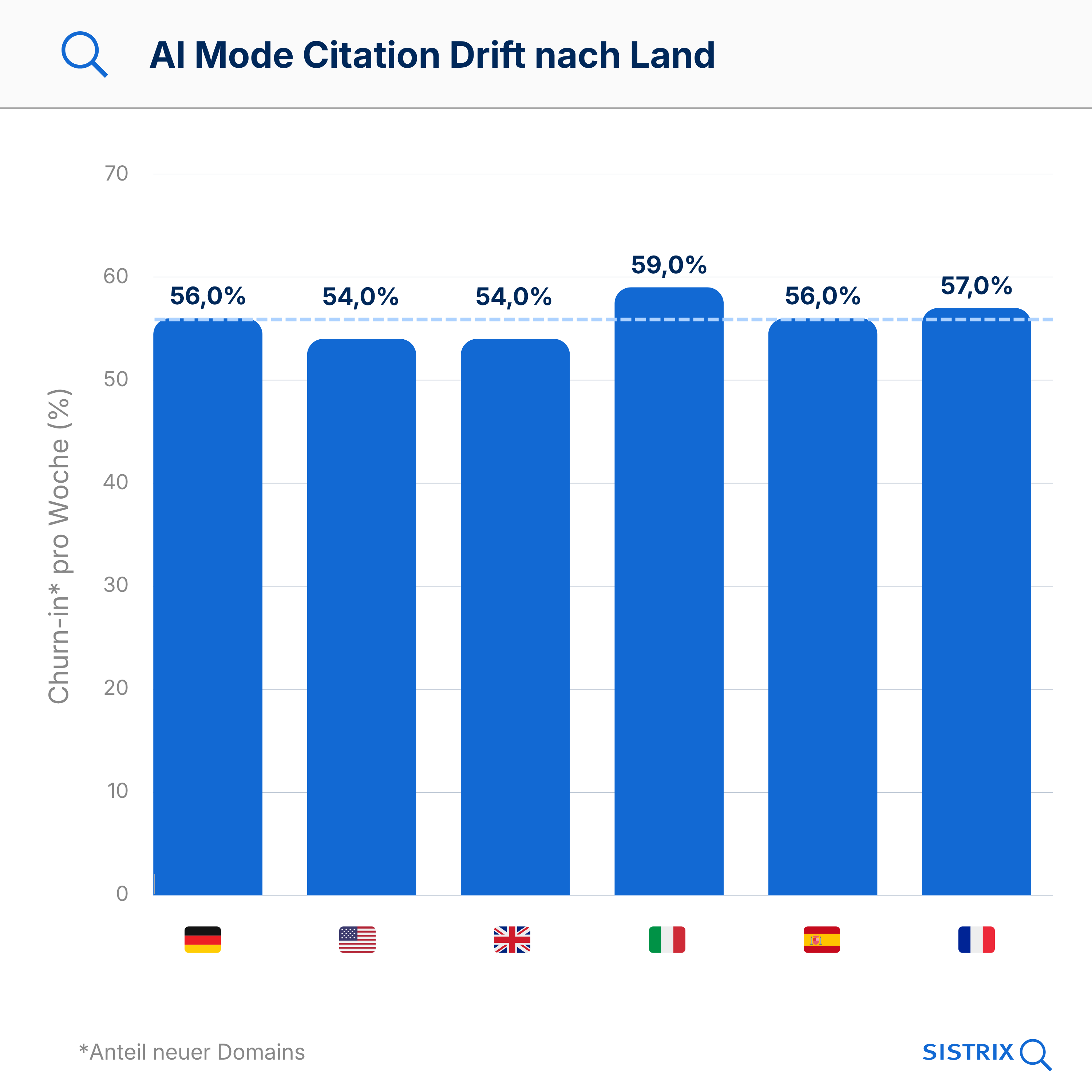

- Citation Drift ist global und dauerhaft. Die Drift-Raten liegen über sechs Länder hinweg konsistent bei 54-59%, ohne Abflachung über den 17-Wochen-Zeitraum. Das ist kein Einführungseffekt, der sich auswächst, sondern Strukturmerkmal der Plattformen.

Drei Plattformen, drei Citation-Architekturen

Die bisher veröffentlichten Drift-Zahlen für AI-Plattformen sind aggregiert: eine Zahl pro Plattform, meistens auf Monatsbasis. Das ist als erste Näherung okay, verdeckt aber mehr als es zeigt. Google AI Overviews, Google AI Mode und ChatGPT Search funktionieren in der Citation-Auswahl fundamental unterschiedlich, und eine gemittelte Zahl macht aus drei verschiedenen Dingen eins.

Begriffe:

- Churn-in beschreibt, wie viele der zitierten Domains in einer Woche neu sind, also in der Vorwoche noch nicht vorkamen.

- Retention beschreibt, wie viele der Domains aus der Vorwoche es in die nächste Woche geschafft haben.

- Peripheral/ Karussell bezeichnet alle Domains in einer AI-Antwort, die nicht zum stabilen Kern gehören. Sie tauchen auf, verschwinden wieder und werden wöchentlich durch andere ersetzt.

- Core/ Kern bezeichnet die wenigen Domains in einer AI-Antwort, die dauerhaft präsent bleiben. Ihr Churn-in liegt bei nahezu 0%: Sie werden Woche für Woche zitiert, unabhängig davon, welche anderen Quellen kommen und gehen.

Google AI Overviews: der geschlossene Kreis

AI Overviews sind die stabilste der drei Plattformen. Im Median werden 11 Domains zitiert, davon sind 8 dauerhaft präsent. Das klingt zunächst beruhigend, die Stabilität verteilt sich aber ungleich.

Bei 53% aller Prompts ändert sich über 17 Wochen keine einzige Quelle. Bei 28% gibt es vereinzelte Wechsel. Und bei 19% driften die Quellen genauso stark wie beim AI Mode, mit 46% Churn-in. AI Overviews sind also nicht gleichmäßig stabil, sondern gespalten in eine Mehrheit, bei der sich gar nichts bewegt, und eine Minderheit, bei der alles rotiert.

Dass das kein Messartefakt ist, haben wir geprüft: bei 87% der stabilen Prompts ändert sich der generierte Antworttext von Woche zu Woche, nur die zitierten Domains bleiben identisch. AI Overviews schreiben also jede Woche neue Sätze, greifen aber auf dieselben acht Quellen zurück. Wer einmal drin ist, bleibt drin. Wer nicht drin ist, kommt auch nicht mehr rein.

Beispiel: Für „1 unze silber verkaufen“ zitieren die AI Overviews über 17 Wochen exakt dieselben 8 Domains: gold.de, goldsilbershop.de, philoro.ch, raiffeisen.ch und vier weitere. Null Bewegung. Für „städtereise über weihnachten“ dagegen sieht es jede Woche anders aus. Vermutlich weil die Antwort auf „wo kaufe ich mein Silber“ weniger saisonal ist als die Frage „wohin an Weihnachten“.

Google AI Mode: wenige bleiben, viele wechseln

Beim AI Mode sieht die Welt anders aus. Pro Antwort werden 14-16 Domains zitiert, davon wechseln 56% jede Woche. Klingt dramatisch, und das stimmt auch. Aber es lohnt sich, genauer hinzuschauen: nicht alle Domains driften gleich.

86,5% der untersuchten Prompts haben einen stabilen Kern aus 1-5 Domains, die über Wochen und Monate präsent bleiben. Die restlichen Domains rotieren dagegen zu 89% pro Woche.

Beispiel: Für „welche filme gibt es bei paramount+?“ bleibt paramountplus.com über den gesamten Zeitraum im Core. Das ist wenig überraschend. Neben Paramount stehen in Woche 1 moviepilot.de, businessinsider.de und justwatch.com. In Woche 2 sind alle drei weg, dafür kommen 4kfilme.de, serienjunkies.de und dslweb.de. Paramount bleibt, die anderen wechseln sich ab.

Wer bildet den Core? YouTube und Amazon sind häufig vertreten, das überrascht niemanden. Bemerkenswerter: bei 83% der Prompts ist auch mindestens eine Fach-Domain im stabilen Kern. Es gewinnen also nicht nur die großen Plattformen.

Und das Ganze ist bemerkenswert länderunabhängig:

| Land | Churn-in / Woche | Retention / Woche | Domains / Antwort |

|---|---|---|---|

| DE | 56% | 46% | 13,5 |

| US | 54% | 49% | 16,1 |

| UK | 54% | 49% | 15,7 |

| IT | 59% | 43% | 13,7 |

| ES | 56% | 44% | 11,8 |

| FR | 57% | 43% | 12,3 |

Churn-in und Retention addieren sich nicht zu 100%, weil sie unterschiedliche Bezugsgrößen haben. Churn-in fragt: Wie viele der heutigen Quellen sind neu? Retention fragt: Wie viele der Quellen von letzter Woche sind noch da? Wenn eine Antwort in der einen Woche beispielsweise acht Quellen hatte und in der nächsten Woche zwölf, haben die beiden Werte eine andere Relation zur Gesamtzahl.

ChatGPT Search: totale Fluktuation

ChatGPT Search ist das Extrem. 74% der Domains sind jede Woche neu. Stabile Core-Strukturen sind selten: der mediane Prompt hat keine einzige Domain, die über alle 17 Wochen präsent ist. Zum Vergleich: beim AI Mode liegt der Median bei ca. 2 stabilen Core-Domains pro Prompt. Es gibt bei ChatGPT durchaus Prompts mit stabilen Quellen, aber sie sind die Ausnahme, nicht die Regel.

Dazu kommt: ChatGPT zitiert deutlich weniger Quellen. Im Median nur 3-4 Domains pro Antwort, gegenüber 14-16 beim AI Mode. Und jetzt wird es interessant: selbst bei deutschen Suchanfragen sind 68% der ChatGPT-Core-Quellen englischsprachig. Wer in Deutschland ChatGPT fragt, bekommt in der Mehrheit Antworten aus englischen Quellen serviert.

Beispiel: Für „welche alternativen gibt es zu fineprint?“ zitiert ChatGPT in Woche 1 insgesamt 18 Domains, darunter chip.de, reddit.com, alternativeto.net. In Woche 2: 3 komplett andere (adobe.com, dopdf.com, papercut.com). In Woche 3: wieder 5 andere (cutepdf.com, foxitsoftware.com, gonitro.com). Kein einziger Overlap zwischen den drei Wochen. Die Antwort mag jede Woche plausibel klingen, mit konsistenter Quellennutzung hat das nichts zu tun.

Die Marken-Domain bleibt, der Rest rotiert

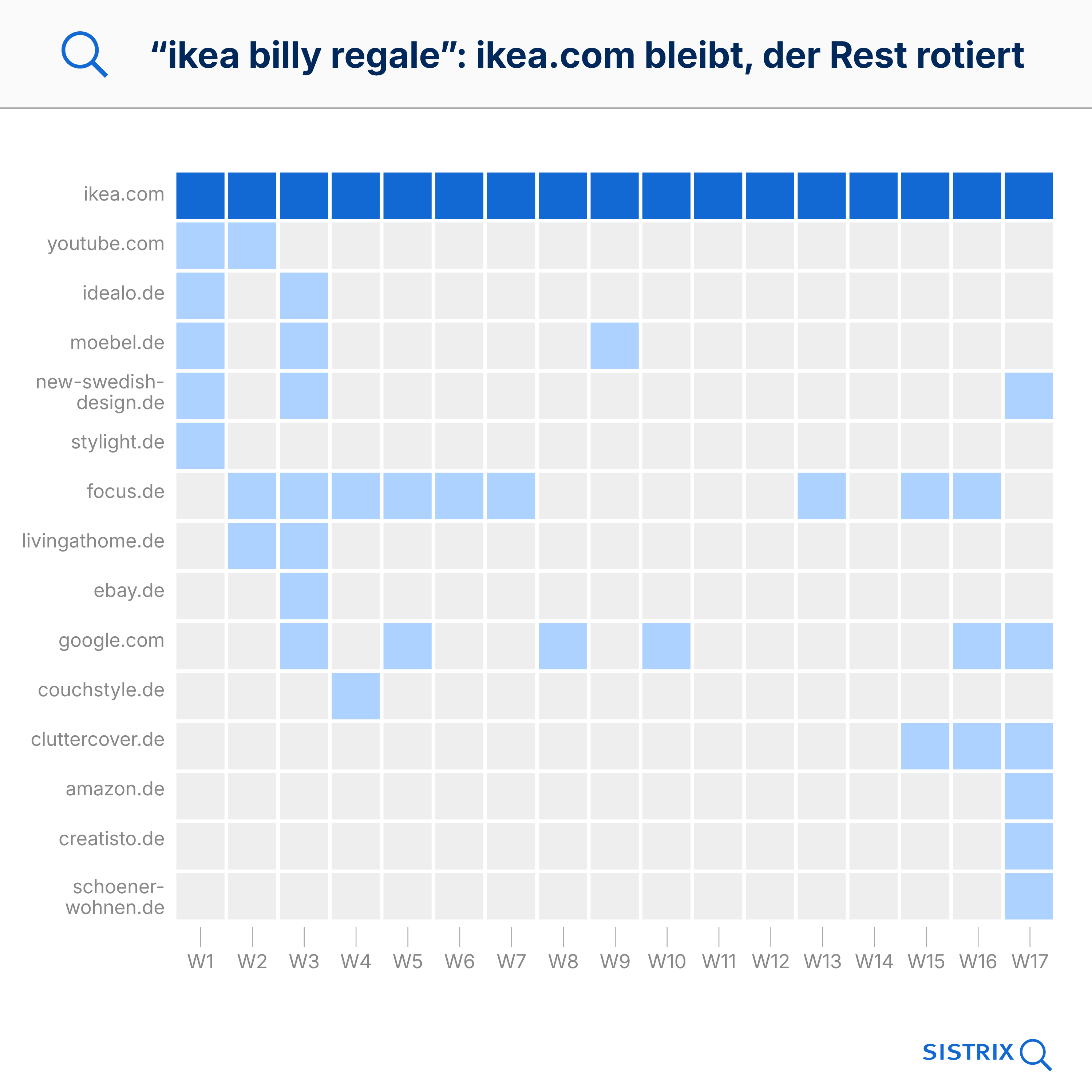

Dass bei einer Suche nach „ikea billy regale“ am Ende ikea.com zitiert wird, ist wenig überraschend. Interessanter ist, wie konsequent das passiert, und was mit den Co-Citations daneben geschieht.

Beim Google AI Mode ist die eigene Marken-Domain nur bei 43% der Brand-Queries in allen 17 Wochen präsent. In der Mehrheit der Fälle rutscht also selbst die naheliegendste Quelle irgendwann einmal aus dem Citation-Set. Bei 66% bleibt sie immerhin in mindestens 80% der Wochen drin. Brand-Queries driften insgesamt 20% weniger als der Durchschnitt (45% vs. 56% Churn-in), also spürbar stabiler, aber nicht dramatisch anders.

Das eigentliche Muster zeigt sich an den Co-Citations daneben. Die 12-15 anderen Domains, die neben der Marke zitiert werden, rotieren zu 70% pro Woche. Starke Marken sitzen also fest, der Platz daneben wird wöchentlich neu vergeben.

Beispiel: Für „ikea billy regale“ ist ikea.com in 17 von 17 Wochen vertreten. In Woche 1 stehen daneben idealo.de, moebel.de und stylight.de. In Woche 17 sind das amazon.de, cluttercover.de und creatisto.com. Komplett ausgetauscht. Nur IKEA bleibt.

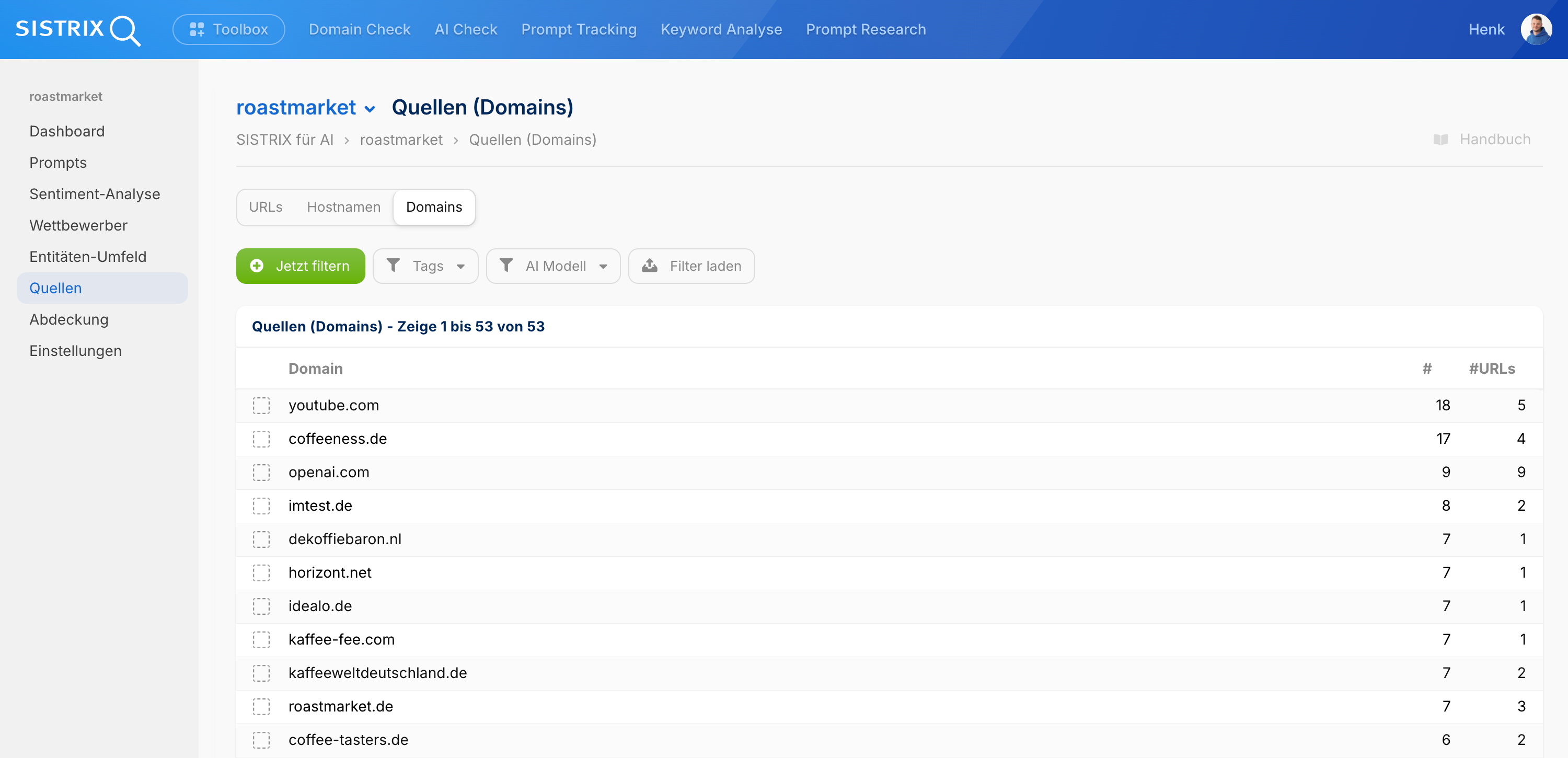

Wer wissen will, ob die eigene Domain zum Core oder zur Peripherie gehört, kann das im SISTRIX Prompt Tracking direkt nachvollziehen. Dafür kann anhand der Prompt Research ein Set an Prompts definiert werden, die für die eigene Marke relevant sind. SISTRIX ermittelt dann täglich, ob und wie oft die eigene Marke in den Antworten der KI-Systeme auftaucht, und welche Domains als Quellen herangezogen werden.

So wird beispielsweise sichtbar, ob für die eigene Marke auch die eigene Domain dauerhaft im Citation-Set verankert ist oder wöchentlich rein- und rausfällt. SISTRIX für AI und Chatbots ist für alle Accounts kostenlos. Wer es ausprobieren möchte, kann sich einen kostenlosen Testaccount anlegen.

Welche Domain-Typen überleben den Citation Drift?

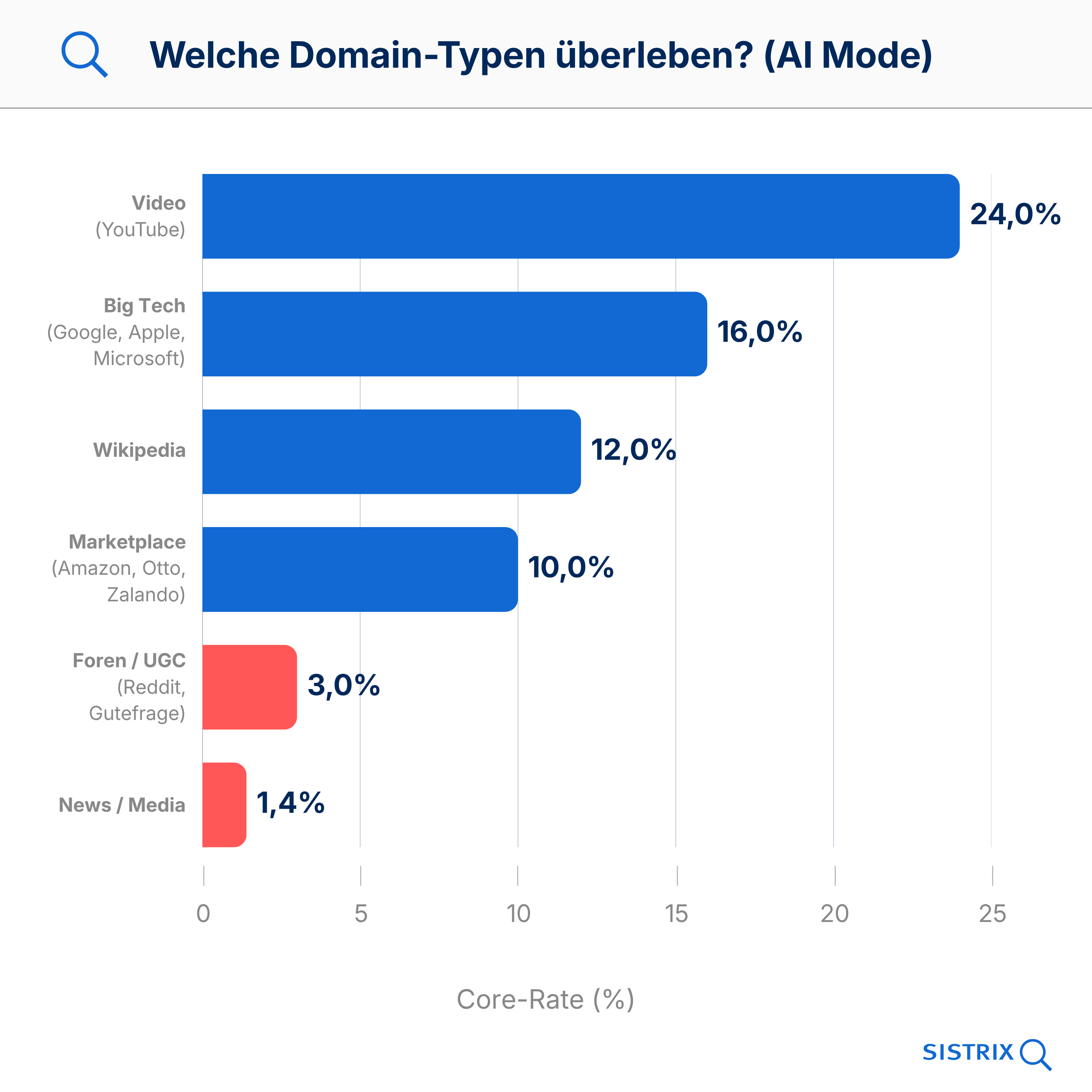

Nicht alle Seitentypen sind gleich betroffen. Wir haben die zitierten Domains in Kategorien eingeteilt und geschaut, wie oft sie es in den stabilen Kern einer Antwort schaffen.

Google AI Mode: klare Hierarchie

| Domain-Typ | Median Präsenz | Core-Rate |

|---|---|---|

| Video (YouTube) | 53% | 24% |

| Big Tech (Google, Apple, Microsoft) | 41% | 16% |

| Wikipedia | 24% | 12% |

| Marketplace (Amazon, Otto, Zalando) | 18% | 10% |

| News / Media | 12% | 1,4% |

| Foren / UGC (Reddit, Gutefrage) | 12% | 3% |

YouTube ist der klare Gewinner. Die Plattform ist in mehr als der Hälfte aller Stichtage als Quelle präsent und landet mit 24% Core-Rate am häufigsten dauerhaft im Kern. Dass ausgerechnet die Google-eigene Videoplattform so gut abschneidet, dürfte niemanden wirklich überraschen.

Am anderen Ende des Spektrums stehen News-Seiten mit einer Core-Rate von 1,4%. Nachrichtenartikel sind in AI-Antworten ein Einwegticket. Sie werden zitiert und sind eine Woche später wieder weg. Für Verlage, die ihre Zukunft auf GEO stützen wollen, ist das keine einfache Botschaft.

ChatGPT: keine klare Hierarchie

Bei ChatGPT zeigt sich kein vergleichbares Muster. Die Unterschiede zwischen den Domain-Typen sind gering, und auch Domains, die man intuitiv erwarten würde, erscheinen nicht systematisch öfter im stabilen Kern als andere. Das passt zum Bild aus der Plattform-Sektion: ChatGPT wählt pro Antwort breit aus, ohne dass sich eine bestimmte Kategorie dauerhaft durchsetzt. Für GEO bedeutet das, dass sich bei ChatGPT kein Seitentyp als zuverlässiges Optimierungsziel anbietet.

Was überlebt? Die URL-Klassifikation

Wir haben über 2.500 der zitierten URLs mit einer NLP-Analyse auf Gemini-Basis nach Sprache, Content-Typ, Monetarisierungsmodell, Evergreen-Status und E-E-A-T-Signalen klassifiziert. Das ergibt zwei deutlich unterschiedliche Profile für das, was in Core und Peripheral landet.

Beim Google AI Mode sind Core-Domains zu 80% deutsch (Peripheral: 62%), und 85% der Core-URLs sind evergreen (Peripheral: 77%). Produkt- und Shopseiten dominieren den Kern, Ratgeber und News rotieren durch. Wer also in Deutschland im AI-Mode-Core landen will, sollte auf deutsche, zeitlose Produktseiten setzen, nicht auf Magazin-Artikel.

Bei ChatGPT Search dreht sich das Bild. Core-Domains haben einen E-E-A-T-Score von 16/20, Peripheral nur 14/20 (der deutlichste E-E-A-T-Unterschied aller untersuchten Plattformen). Die Sprache kippt ins Gegenteil: ChatGPT-Core ist zu 68% englischsprachig, selbst bei deutschen Suchanfragen. Dokumentation und institutionelle Quellen bilden den Kern, redaktionelle Ratgeber rotieren.

Die beiden Plattformen belohnen also nahezu gegensätzliche Content-Profile. Sprache, Content-Typ und Monetarisierungsmodell sind strukturelle Eigenschaften einer Website, die sich nicht mal eben für GEO umbauen lassen. Für manche Seiten passt ein Profil besser, für andere beide, für wieder andere keines davon. Welche Position man hat, ist damit eine Frage der Ausgangslage, nicht nur der Optimierung.

Jede Plattform zitiert andere Quellen

Selbst Googles eigene Produkte stimmen kaum überein. Für denselben Prompt zitieren die AI Overviews und der AI Mode zu 83% unterschiedliche Domains. Der Jaccard-Index, der die Überschneidung misst, liegt bei 0,17. Anders ausgedrückt: von allen Domains, die in einer der beiden Antworten vorkommen, tauchen nur 17% in beiden auf. Zwischen dem AI Mode und ChatGPT ist die Überschneidung mit 0,125 sogar noch niedriger.

Beispiel: „wie kann ich kostenlos online tv schauen?“

- AI Mode zitiert: check24.de, dslweb.de, hoerzu.de (Vergleichsportale und TV-Guides)

- ChatGPT zitiert: arte.tv, zdf.de, 3sat.de (die Sender direkt)

- Gemeinsam: nur joyn.de

Ein Grund für die niedrige Überschneidung liegt in den strukturellen Präferenzen der Plattformen. Der AI Mode greift zu 80% auf deutschsprachige Quellen zurück, ChatGPT zu 68% auf englischsprachige, auch bei deutschen Suchanfragen. Schon allein dieser Sprach-Bias sorgt dafür, dass sich die Quellen-Pools der beiden Plattformen für den deutschen Markt kaum überlappen können.

Für GEO heißt das: eine Strategie, die für den AI Mode funktioniert, trifft ChatGPT oft gar nicht und umgekehrt. Plattformspezifische Citation-Strategien sind damit nicht optional, sondern Grundvoraussetzung.

Domain-Level vs. URL-Level: unsere Zahlen sind konservativ

Alle bisher genannten Drift-Zahlen basieren auf Domain-Vergleichen. Auf URL-Ebene, also der konkreten Unterseite und nicht nur der Website, ist der Drift noch deutlich stärker: 85% pro Woche gegenüber 74% auf Domain-Ebene. Selbst wenn eine Domain stabil im Citation-Set bleibt, wechselt Google häufig die konkrete Unterseite.

Beispiel: imdb.com bleibt für „action adventure movie“ als Quelle erhalten. In Woche 1 wird

/list/ls594655800/verlinkt, in Woche 2/chart/moviemeter/. Eine komplett andere Seite auf derselben Domain.

Für GEO heißt das: das Ranking einer einzelnen URL in AI-Antworten ist kein sinnvolles Messziel. Domain-Präsenz ist messbar und steuerbar. Welche konkrete URL auf dieser Domain in einer bestimmten Woche erscheint, lässt sich aber nicht steuern.

Citation Drift ist global

Die Drift-Raten beim Google AI Mode sind über alle sechs untersuchten Länder hinweg bemerkenswert konsistent: zwischen 54% und 59% Churn-in pro Woche, unabhängig von Land und Sprache. Citation Drift ist kein US-spezifisches oder deutsches Phänomen, sondern ein Strukturmerkmal der Plattform.

Bei ChatGPT zeigen sich dagegen Länderunterschiede. Deutschland ist mit 74% deutlich volatiler als UK (60%) und Frankreich (42%). Die Ursache liegt vermutlich in der unterschiedlichen Crawl-Abdeckung für verschiedene Sprachen.

Über den gesamten 17-Wochen-Zeitraum ist kein Trend erkennbar. Keine Stabilisierung, kein Abflachen. Wer auf den Moment wartet, in dem sich die AI-Plattformen auf ein festes Set von Quellen einigen, kann lange warten.

Was bedeutet das für GEO?

Die Befunde dieser Studie lassen sich in drei konkrete Handlungsempfehlungen übersetzen.

- Content-Planung: Evergreen vor News, Produkt vor Ratgeber.

Die Core-Raten nach Content-Typ geben eine klare Priorisierung vor. Evergreen-Inhalte, Produkt- und Shopseiten haben systematisch höhere Chancen, dauerhaft zitiert zu werden. News-Artikel sind mit 1,4% Core-Rate für Citation-Ziele praktisch nicht geeignet, was sie als Traffic-Format aber weiter sinnvoll macht, nur eben nicht als GEO-Invest. Video ist mit 24% Core-Rate der stärkste Content-Typ überhaupt. Für Unternehmen, die bisher keinen strukturierten YouTube-Kanal betreiben, lohnt sich hier ein zweiter Blick. - Plattform-Fokus nach Ausgangslage setzen.

AI Overviews, AI Mode und ChatGPT zitieren für dieselbe Frage zu mehr als 80% unterschiedliche Domains. Gleichzeitig belohnen sie unterschiedliche Content-Profile (deutsche Shop-Seiten im AI Mode, englische Dokumentation bei ChatGPT). Die meisten Unternehmen sind strukturell für eine der Plattformen besser aufgestellt als für die anderen. Statt alle drei gleichwertig zu bespielen, ist es meist sinnvoller, die passende Plattform als Optimierungsziel zu wählen und die anderen als Monitoring-Ziel zu behandeln. - GEO-Erwartungen kalibrieren.

Klassische SEO-Versprechen wie „Position 1 für Keyword X“ funktionieren in AI-Antworten nicht. GEO ist am Ende die Optimierung von Zufälligkeiten, mit denen LLMs arbeiten, und bei 56% wöchentlicher Drift ist eine einzelne Citation-Platzierung keine reproduzierbare Leistung, sondern eine Momentaufnahme. Für Projekte bedeutet das, die Erfolgsmessung auf Präsenz über Zeiträume zu legen, nicht auf Einzelresultate, und gegenüber Stakeholdern klare Erwartungen zu setzen: GEO ist ein kontinuierlicher Prozess, keine einmalige Optimierung mit dauerhaftem Ergebnis.

Datengrundlage

Diese Studie basiert auf dem SISTRIX AI Research Index und umfasst 82.619 qualifizierte Prompts mit 1.548.213 Snapshots. Erfasst wurden sechs Länder (Deutschland, USA, UK, Italien, Spanien, Frankreich), drei Plattformen (Google AI Mode, Google AI Overviews, ChatGPT Search) und 17 Wochen von 2025-12-17 bis 2026-04-08 mit wöchentlichen Stichtagen. Zusätzlich wurden 2.556 Source-URLs nach Sprache, Content-Typ und E-E-A-T klassifiziert.

Alle Drift-Metriken basieren auf Domain-Level-Vergleichen zwischen konsekutiven wöchentlichen Snapshots. Die Hauptmetriken sind Churn-in (Anteil neuer Domains pro Woche) und Retention (Anteil überlebender Domains).

Limitationen: Die ChatGPT-Daten umfassen nur Prompts mit konsistenter Quellennennung. Die genannten Drift-Raten sind konservativ, auf URL-Ebene liegen sie 15% höher.