Im August 2015 hat Parsely.com – eine Content Analyse Plattform – einen „Authority Report“ veröffentlicht, in dem sie behaupten, dass Facebook Google als Haupttrafficlieferant für Verleger abgelöst hat. Was ist an dieser Aussage dran? Viele europäische Verleger sind sicherlich anderer Meinung.

Aber gut, anderthalb Jahre und mehrere Authority Reports später überrascht es sehr, dass viele europäische und amerikanische Institutionen und Sektoren (Universitäten, Webseiten-Besitzer, Verleger, und viele mehr) diese Aussage als einzige Wahrheit übernommen haben. Dies ist nicht der Fall.

Die Ansicht ist jedoch kein Wunder, wenn man beachtet, wie sich die Aussage verbreitet hat: Die Nytimes.com schreibt „Facebook eclipsed Google for the share of referral traffic to publishers“. Fortune.com fängt ihren Artikel mit dem Satz „Facebook is no longer just vying with Google but has overtaken it by a significant amount“ an. Und selbst Marketing Land schreibt „Facebook has landed the latest punch in the heavyweight battle with Google for referral traffic supremacy“.

Ich glaube, diese Aussage konnte so populär werden, da es so gut wie keine Studien gibt, die für Vergleichswerte sorgen. Aus diesem Grund möchte ich mir die Parsely-Studie heute näher anschauen und eigene Zahlen anbieten.

Die Studie von Parsely ist statistisch nicht repräsentativ

Obwohl man als Leser nur einen begrenzten Einblick in die Daten und Methodiken der Studie bekommt – es lassen sich nur zwei Schaubilder und einige Kommentare von Parsely aus anderen Interviews finden – gibt es genügend Anhaltspunkte um zu schlussfolgern, dass diese Studie statistisch nicht repräsentativ ist. Bei Parselys Probandenauswahl handelt es sich nicht um eine Zufallsstichprobe.

Wenn wir in Erfahrung bringen möchten, wie viel der durchschnittliche New Yorker Bürger im Monat verdient, werden wir sehr unterschiedliche Ergebnisse erhalten, abhängig davon, ob wir die Umfrage an der Wall Street oder in Queens durchführen. Damit unsere Studie repräsentativ wird, müssen wir ein per Zufall ausgewähltes Set an Teilnehmern aus der Gesamtheit aller New Yorker Bürger befragen. Jeder Teilnehmer wird per Zufall ausgewählt.

Eine einfache Zufallsstichprobe soll eine unbefangene Repräsentation einer Gruppe ermöglichen. Diese Art der Stichprobenerhebung wird als faire Methode angesehen, eine Stichprobe aus einer größeren Allgemeinheit auszuwählen, da jedes Mitglied der Allgemeinheit die gleiche Chance hat, in die Stichprobe aufgenommen zu werden. Parsely hat für ihre Auswertung leider nur ihre eigenen Verlagskunden für die Stichprobe genutzt. Damit wurde eine Stichprobe von Teilnehmern erstellt, den gemein ist, dass sie ein Tool nutzen um zu überwachen, wie ihre Leser auf die Inhalte in den Sozialen Medien reagieren.

Google ist die wichtigste Trafficquelle in Europa

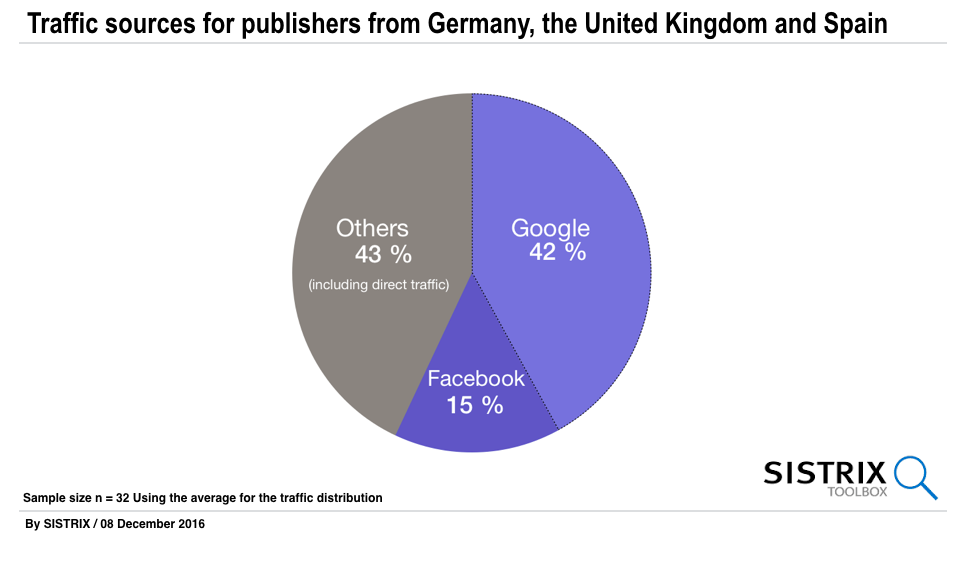

Europäer nutzen Google weitaus mehr als Amerikaner. Google hat einen Marktanteil von ungefähr 92% in Europa (in Deutschland, dem Vereinten Königreich und Spanien sind es ungefähr 95%). Ich habe, in diesen Märkten für die Google so wichtig ist, Redakteure und SEOs der meistgelesenen Newsseiten in Deutschland, dem Vereinten Königreich und Spanien gebeten, uns ihre Trafficdaten zur Verfügung zu stellen und hier ist das Ergebnis:

Unser Stichprobenumfang beträgt n = 32 und auch hier ist es wichtig darauf hinzuweisen, dass es sich nicht um eine Zufallsstichprobe handelt. Damit sind auch unsere Daten, genau wie Parselys, statistisch nicht repräsentativ. Die Daten zeigen jedoch trotzdem sehr beeindruckend, dass sich in anderen Märkten ein ganz anderes Bild ergibt. Eins welches Parselys Aussage, dass Facebook Google als Haupttrafficlieferant für Verleger überholt hat, komplett widerlegt.

Und obwohl wir versprechen mussten, die genauen Teilnehmer nicht zu nennen, könnt ihr euch sicher sein, dass es sich bei unser Stichprobe um Daten von Schwergewichten der Newsszene handelt. Diese Auswertung zeigt zudem wie erfolgreich europäische SEOs darin sind die Möglichkeiten und Potentiale, die Google bietet, zu erkennen und zu nutzen.

Wenn ihr gerne weitere Trafficdaten von europäischen Zeitungen sehen möchtet, könnt ihr bei Twitter nach dem Hashtag #TrafficLeaks suchen. Dort findet ihr eine große Anzahl an Auswertungen von großen Verlegern aus Deutschland, Österreich und der Schweiz.

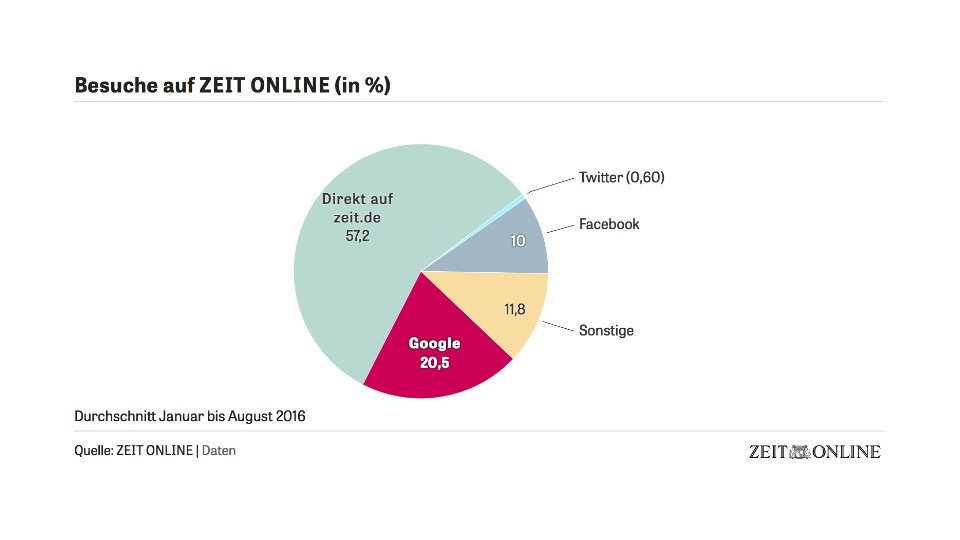

Hier haben wir die Werte für eines der größten deutschsprachigen Online News Angebote, die Zeit.de:

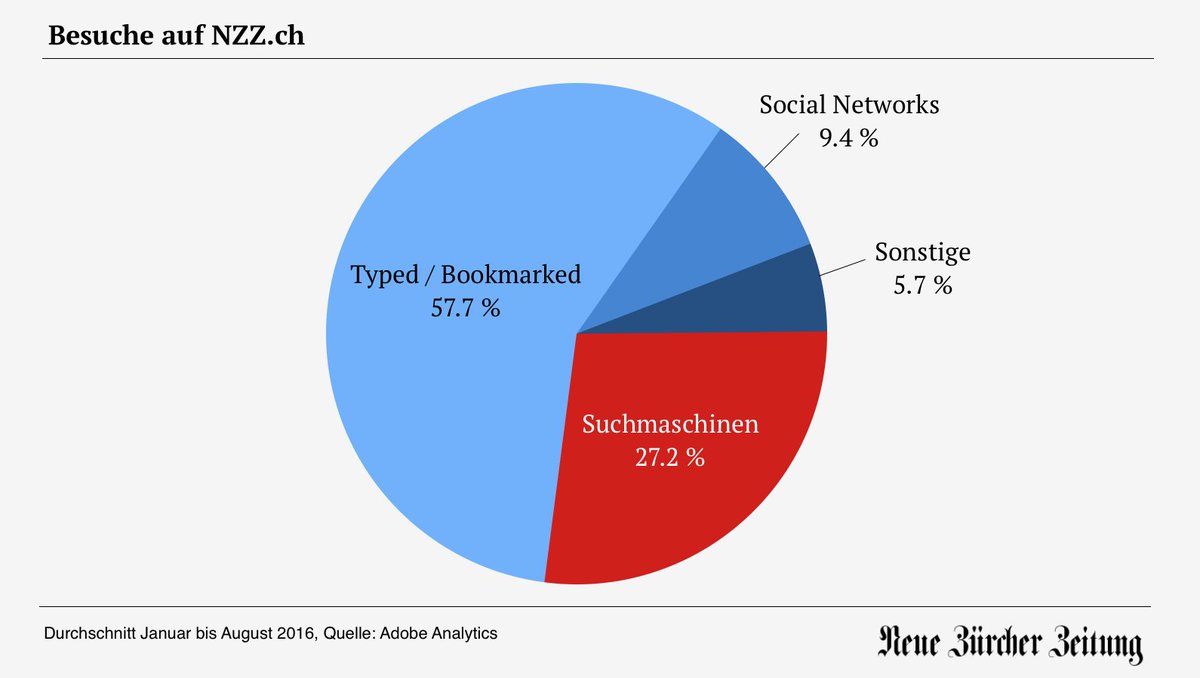

Ich bin mir sicher, alle Redakteure sind zudem mit der Neuen Züricher Zeitung aus der Schweiz bekannt. Hier sind die Traffic Daten für NZZ.ch:

Fazit

Es ist sehr gut möglich, dass Facebook immer und immer relevanter wird. Jedoch ist es auch weiterhin so, dass Google viele Potentiale bereithält, wenn man mit einer gut durchdachten SEO Strategie arbeitet und diesen Kanal angemessen nutzt.

Es ist wichtig festzuhalten, dass Soziale Medien eine gute Möglichkeit bieten, viel Traffic auf einen neuen Artikel zu lenken. Dieser Traffic kann, abhängig vom Interesse den der Beitrag generiert, einen Tag oder eine Woche anhalten. Eine solide SEO Strategie hingegen ist ein Investment, welches einen kontinuierlichen Trafficfluss über Jahre hinweg erzeugen kann.

Versteht mich bitte nicht falsch, beide Kanäle sind extrem wichtig. Google News und Soziale Medien können neuen Inhalten die notwendige Starthilfe geben, wohingegen Googles Websuche eher dafür geeignet ist Besucher potentiell auf alle Inhalte eurer Seite zu schicken.

Ich möchte mich an dieser Stelle ganz herzlich bei allen SEOs und Redakteuren bedanken, die Ihre Daten mit uns geteilt und unsere Auswertung damit möglich gemacht haben!

Ich hoffe der Artikel hat euch gefallen!