GEO ist kein Buzzword mehr. Mit der Ausschreibung eines ‚GEO Partner Managers‘ hat Google den Begriff jetzt erstmals offiziell verwendet.

- Was genau ist GEO?

- Strategische Einordnung: Die drei Engine-Typen

- RAG (Retrieval-Augmented Generation)

- Sichtbarkeit verändert sich. Mit SISTRIX lässt sie sich messen

- AI Check: Die Bestandsaufnahme

- Prompt Research: Die Keyword-Recherche

- Prompt Tracking: Das laufende Monitoring

- Der Prozess der Informationsselektion: Retrieved, Cited, Trusted

- Das Risiko der Irrelevanz: AI Slop ist der neue Spam

- Die drei Stufen der Content-Einordnung

- Technische Voraussetzungen für GEO

- Case Study: Was wir vom Claude-Leak lernen

- GEO vs. SEO: Warum die Trennung in die Irre führt

- Die ökonomische Realität von GEO: Welche Inhalte lohnen sich künftig noch?

- Rechtliche Dimension: Trainingsdaten und Opt-out

- Das Blackbox-Problem: Unvorhersehbarkeit als Konstante

- Der Paradigmenwechsel: Vom Ranking zur Empfehlung

- Warum SEO weiterhin unverzichtbar bleibt

- Strategische Roadmap: Von SEO zu GEO

- Strategische Analyse statt Aktionismus

Mit dem Einzug der künstlichen Intelligenz in den Suchalltag, durch AI Overviews, Gemini oder ChatGPT, ändern sich die Spielregeln fundamental. Es geht nicht mehr nur darum, in einer Liste von Links oben zu stehen, sondern darum, wie präsent eine Marke innerhalb der KI-generierten Antworten ist.

Was genau ist GEO?

Generative Engine Optimization (GEO) bezeichnet die strategische Optimierung von Inhalten, technischer Infrastruktur und Markenautorität für die Auswahl-, Gewichtungs- und Synthesemechanismen generativer KI-Systeme wie Google Gemini oder ChatGPT.

Der Begriff stammt aus der akademischen Forschung (u. a. Princeton University) und beschreibt den Prozess, Inhalte so aufzubereiten, dass sie von KI-Systemen als vertrauenswürdige Quellen identifiziert, verarbeitet und aktiv zitiert werden.

Ziel von GEO ist es, die sichtbare Präsenz einer Marke innerhalb synthetisch erzeugter KI-Antworten zu maximieren. Operationalisiert wird dieser Erfolg über den sogenannten „Share of Model“. Diese Metrik ist das KI-Äquivalent zum klassischen Share of Voice und gibt an, wie hoch der prozentuale Anteil der Nennungen einer Marke im Output eines Sprachmodells im Vergleich zum Wettbewerb ist.

Strategische Einordnung: Die drei Engine-Typen

GEO ist kein „One-Size-Fits-All“-Ansatz. Um Ressourcen effizient zu planen, müssen wir zwischen drei Systemen unterscheiden:

- Suchbasierte Engines (z. B. Perplexity, Google AI Overviews): Diese nutzen Echtzeit-Webzugriff (RAG). Hier greifen GEO-Maßnahmen sofort.

- Trainingsbasierte Modelle (z. B. Claude, Llama): Diese Modelle verlassen sich auf ihr antrainiertes Wissen. Sichtbarkeit entsteht hier nur über langfristige Autorität und Präsenz in den Trainingsdaten (z.B. über Wikipedia, Fachmedien). Aktuelle Informationen werden hier nicht berücksichtigt.

- Hybride Systeme (z. B. Gemini, ChatGPT Search): Diese kombinieren beides. Die KI entscheidet situativ, ob sie internes Wissen nutzt oder externe Quellen hinzuzieht. Die Informationen sind manchmal veraltet und fehlerhaft.

RAG (Retrieval-Augmented Generation)

RAG ist die „Live-Recherche“ der KI. Anstatt nur auf antrainiertes, statisches Wissen zurückzugreifen, sucht die KI bei einer Anfrage zuerst in externen Quellen (z. B. deiner Website) nach aktuellen Informationen (Retrieval) und nutzt diese als Basis für ihre Antwort (Generation). So werden Antworten präziser, aktueller und belegbar. Mehr dazu: Grounding bei Large Language Models.

Sichtbarkeit verändert sich. Mit SISTRIX lässt sie sich messen

Dafür bietet SISTRIX drei aufeinander aufbauende Werkzeuge, die GEO vom abstrakten Konzept zur operativen Praxis machen.

AI Check: Die Bestandsaufnahme

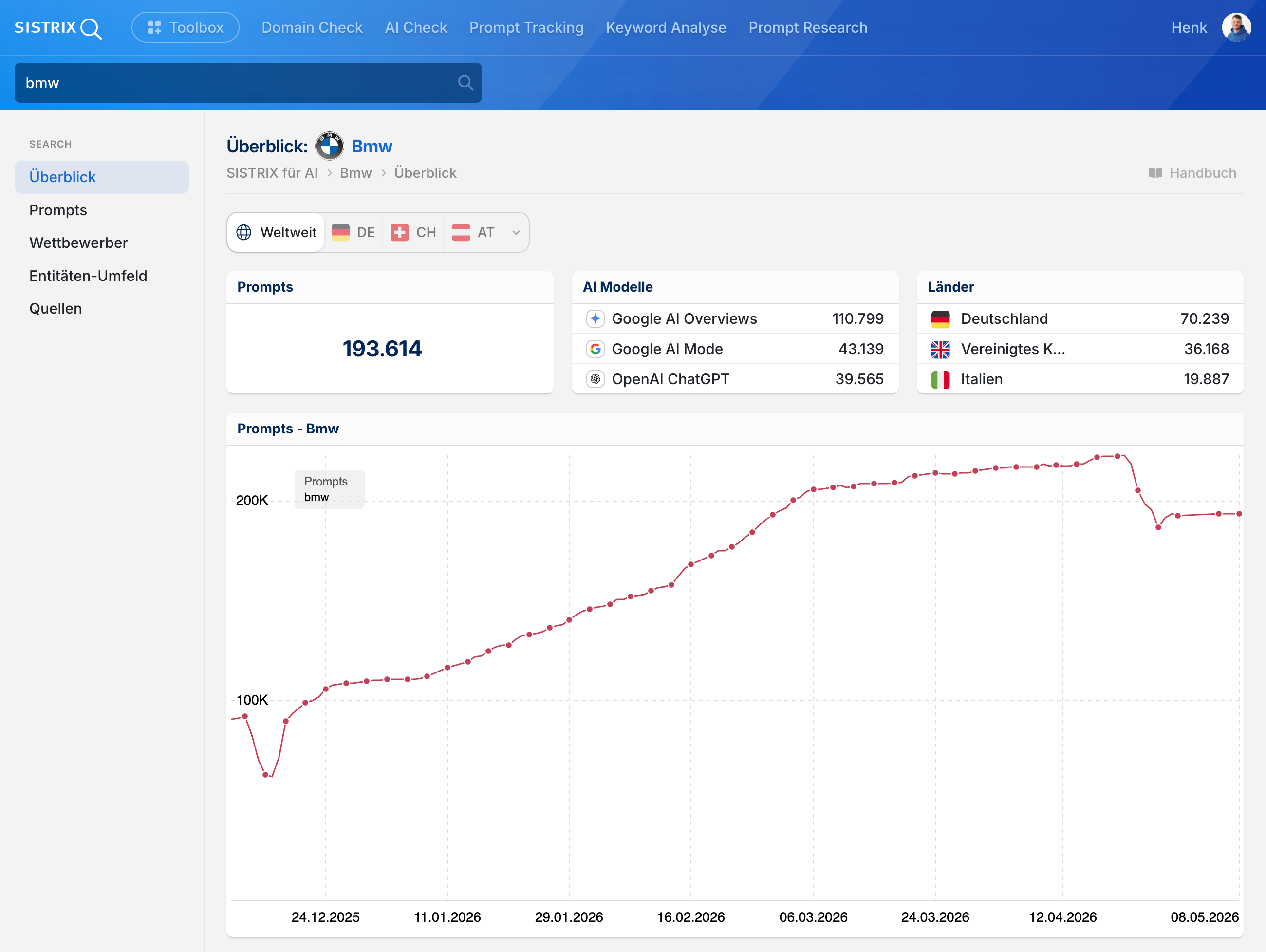

Wer wissen will, wie präsent eine Marke in KI-Antworten ist, beginnt hier.

Der AI Check durchsucht über 61 Millionen Prompts weltweit und zeigt, in wie vielen davon eine Marke als Mention oder Citation auftaucht, aufgeschlüsselt nach Plattform, Land und zeitlichem Verlauf. Die Daten sind vorberechnet und sofort verfügbar. Die aktuelle Sichtbarkeit und die Entwicklung über die letzten Monate kann hier direkt abgelesen werden, ohne vorher ein Projekt anlegen zu müssen, und dient als Ausgangspunkt für weitere strategische Entscheidungen.

Prompt Research: Die Keyword-Recherche

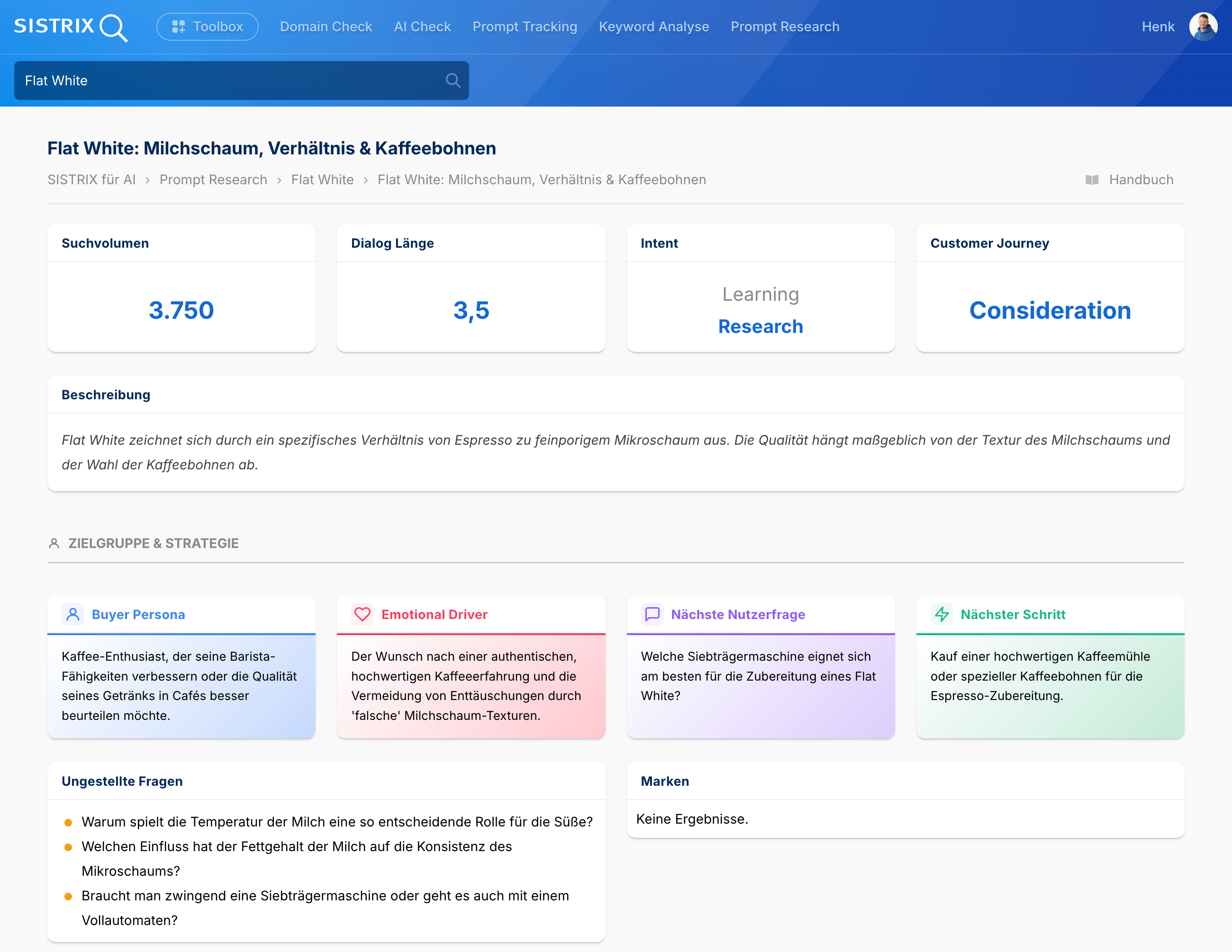

Bevor man optimiert, muss man verstehen, wonach die Zielgruppe überhaupt fragt.

In klassischem Google SEO liefert SISTRIX diese Funktion schon seit Jahren zuverlässig. Dadurch, dass Prompts meist individuell und so nur einmalig gefragt werden, gab es eine ähnliche Funktionsweise in der AI-Suche bisher nicht. Die Prompt Research von SISTRIX schließt diese Lücke. Das Tool clustert über 62 Millionen echte Nutzerfragen zu mehr als 1,4 Millionen Topics und liefert pro Topic Daten zu Intent, Customer Journey Stage, Buyer Persona und Emotional Drivers. Also nicht nur was gefragt wird, sondern warum und von wem.

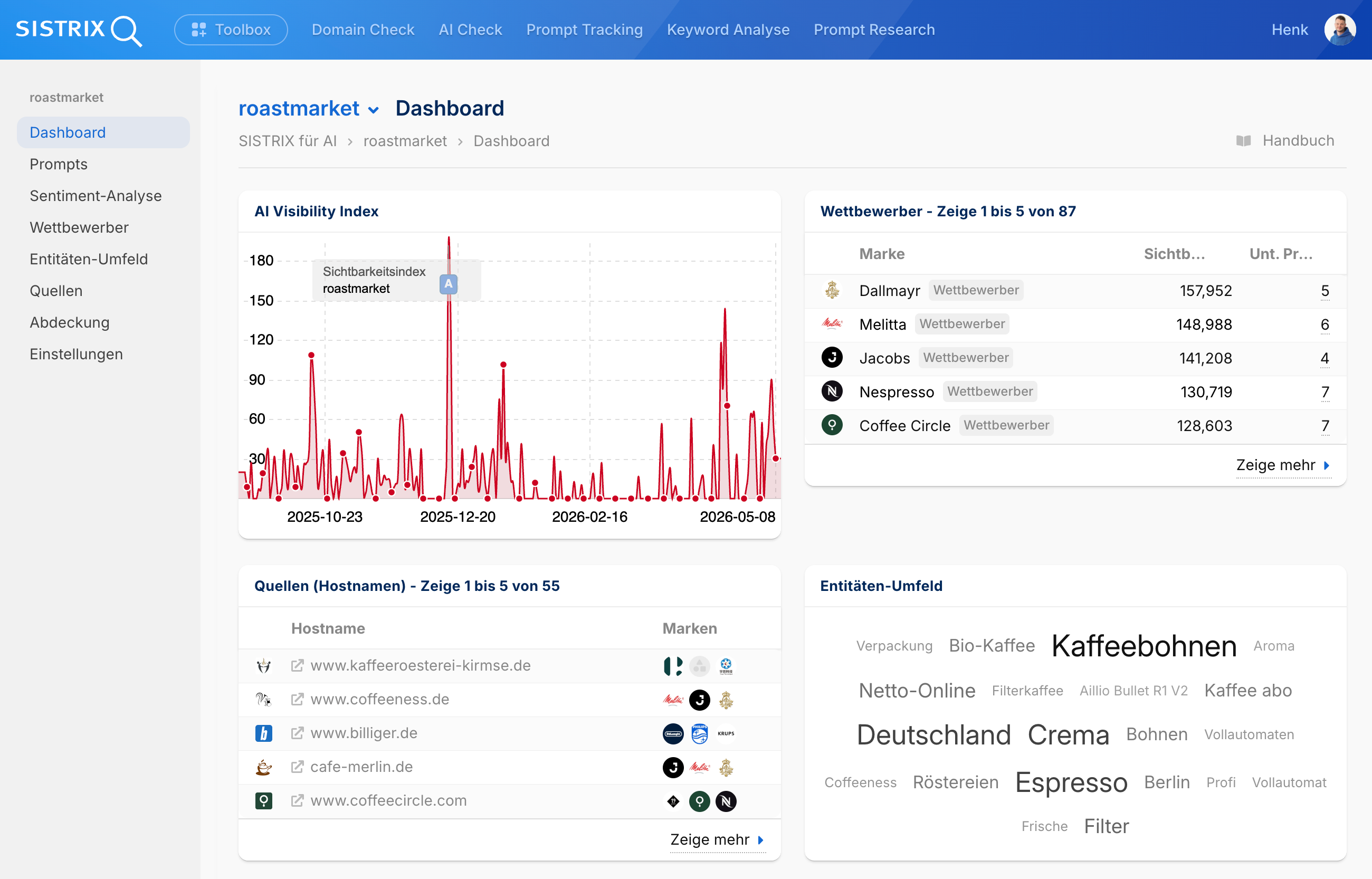

Prompt Tracking: Das laufende Monitoring

Sichtbarkeit in KI-Systemen ist keine stabile Größe.

Modellupdates, neue Wettbewerber, veränderte Nutzergewohnheiten, all das beeinflusst, ob und wie eine Marke in Antworten auftaucht. Prompt Tracking macht diese Dynamik messbar: kontinuierlich, plattformspezifisch und im direkten Wettbewerbsvergleich.

Die drei Tools bauen aufeinander auf: Erst verstehen, was die Zielgruppe fragt. Dann messen, wie präsent die eigene Marke dabei ist. Dann dranbleiben und beobachten, wie sich das entwickelt. Teste SISTRIX 14 Tage kostenlos und miss Sichtbarkeit nicht nur bei Google und Amazon, sondern auch in KI-Suchsystemen.

Der Prozess der Informationsselektion: Retrieved, Cited, Trusted

Damit Inhalte in einer generativen Antwort stattfinden, müssen sie laut einer Analyse von Kevin Indig einen dreistufigen Prozess durchlaufen.

- Inhalte auffindbar machen (Retrieved)

- Bevor ein Modell eine Marke zitieren kann, muss es sie finden.

- Performance: Kurze Server-Antwortzeiten sind essenziell, da LLMs Inhalte oft in extrem engen Zeitfenstern abrufen.

- Prompt-Nähe: Titel und Meta-Daten sollten so formuliert sein, dass sie typischen Nutzer-Prompts entsprechen.

- Markenassoziation: Starke Marken, die bereits im Training mit Attributen wie „zuverlässig“ verknüpft wurden, werden bevorzugt.

- Bevor ein Modell eine Marke zitieren kann, muss es sie finden.

- Inhalte zitierfähig machen (Cited)

- Nur strukturierte und relevante Inhalte schaffen es in das Zitat-Fenster:

- Semantische Struktur: Nutze H-Tags, Tabellen und Listen konsequent. Eine hohe Faktendichte erhöht die Chance auf Passage-Zitate.

- Aktualität: Ein „Last updated“-Zeitstempel mit echten inhaltlichen Änderungen ist ein wichtiges Signal.

- Ranking als Basis: Seiten, die in der klassischen Suche unter den Top 10 ranken, haben eine signifikant höhere Wahrscheinlichkeit, in AI-Antworten berücksichtigt zu werden.

- Nur strukturierte und relevante Inhalte schaffen es in das Zitat-Fenster:

- Vertrauen aufbauen (Trusted)

- Da Nutzer oft nur eine einzige Antwort erhalten, ist Vertrauen die wichtigste Währung:

- Nachweisbare Expertise: Autorenqualifikationen, Entitäten und Studien müssen klar erkennbar sein.

- Faktische Belegbarkeit: KI-Modelle bevorzugen Inhalte, die durch Statistiken und externe Quellen untermauert sind.

- Diese Punkte entscheiden darüber, ob dein Content ignoriert oder als Quelle zitiert wird. Noch wichtiger ist, dass deine Marke empfohlen wird.

- Da Nutzer oft nur eine einzige Antwort erhalten, ist Vertrauen die wichtigste Währung:

Das Risiko der Irrelevanz: AI Slop ist der neue Spam

Dank der neuen KI-Chatbots werden derzeit enorme Mengen automatisch generierten KI-Contents im Netz veröffentlicht. Ein Großteil dieser Inhalte wird künftig weder als Trainingsgrundlage noch als Zitatquelle taugen und von Suchsystemen und LLMs ignoriert.

Das betrifft vor allem drei Arten von Inhalten:

- Vollautomatisierter „AI Slop“: Google führt ein permanentes Wettrüsten gegen massenhaft generierte KI-Inhalte ohne Mehrwert. Liz Reid (Head of Google Search) warnt explizit davor: Inhalte, die lediglich vorhandenes Wissen ohne eigene Perspektive zusammenfassen, werden wie Spam behandelt und aussortiert.

- Fehlender „Information Gain“: Wenn dein Content keine neuen Fakten, Daten oder exklusiven Einblicke bietet, hat die KI keinen Grund, ihn zu bevorzugen. Er wird irrelevant, weil das Modell die Antwort bereits fehlerfrei aus seinem bestehenden Trainingswissen generieren kann. Wer lediglich „10 Tipps zur Steueroptimierung“ zusammenfasst, ohne neue Einblicke oder neue belastbare Zahlen zu liefern, wird von KI-Systemen kaum priorisiert, da das Modell vergleichbare Antworten selbst generieren kann.

- Technische Unsichtbarkeit: Inhalte, die zu langsam laden oder strukturell nicht maschinenlesbar sind, werden von den engen Zeitfenstern der KI-Agenten gar nicht erst erfasst (Retrieval-Fehler). Bei der Datenmenge, die die Modelle zu verarbeiten haben, werden sie nicht lange warten, bis die Informationen auf der Website abrufbar sind.

Die drei Stufen der Content-Einordnung

In der GEO-Logik lässt sich Content also in folgendes Raster einordnen:

| Status des Inhalts | Die Folge |

|---|---|

| Inhalt wird ignoriert. | Keine Berücksichtigung in der Antwort. Keine Sichtbarkeit, kein Traffic, kein Markeneffekt. |

| Inhalt wird als Informationsquelle genutzt. | Inhalte fließen in die KI-Antwort ein, die Marke wird jedoch nicht genannt. Keine sichtbare Wirkung. |

| Inhalt wird zitiert. | Quelle wird genannt oder verlinkt. Sichtbarkeit entsteht, Traffic ist möglich. |

| Inhalt führt zur Markennennung. | Marke wird im Zusammenhang mit einer konkreten Fragestellung genannt (z. B. als spezialisierter Anbieter). Das erzeugt qualifizierte Nachfrage. |

Um aus der Masse herauszustechen, ist die gezielte Analyse wichtig – hierfür kannst du beispielsweise das Prompt Research Tool von SISTRIX nutzen, um zu prüfen, ob und wie deine Themenfelder in generativen Antworten überhaupt stattfinden.

Technische Voraussetzungen für GEO

Damit deine Inhalte in den KI-Antworten von Google, ChatGPT oder Perplexity erscheinen, muss die Technik Barrieren abbauen und der Content maschinell lesbar sein. KI-Systeme arbeiten unter hohem Zeitdruck und mit begrenzten Ressourcen. Webseiten müssen daher wie eine perfekt sortierte digitale Bibliothek funktionieren.

- Eindeutigkeit durch Strukturierte Daten (Schema.org)

- KI-Modelle sind zwar intelligent, aber sie „raten“ ungern. Strukturierte Daten sind wie Etiketten an einem Aktenordner: Sie sagen der KI unmissverständlich, was ein Fakt, ein Preis oder eine Bewertung ist.

- Tipp: Nutze konsequent JSON-LD Markups für Autoren, Produkte und FAQs. Das macht deine Seite zur „Primärquelle“, aus der sich die KI sicher bedient.

- Sauberes HTML statt neuer Formate

- Ein schlanker, sauberer HTML-Code bleibt elementar für die maschinelle Lesbarkeit von Webseiten. Vermeide unnötigen Code-Ballast und komplizierte Scripte, die den eigentlichen Inhalt verdecken. Die KI soll den Hauptinhalt sofort finden, ohne sich durch ein Labyrinth aus Design-Code kämpfen zu müssen.

- Ladegeschwindigkeit: Performance als Türsteher

- In der KI-Suche zählt jede Millisekunde. Wenn ein KI-Bot (wie der Google-Bot oder der GPT-Bot) Informationen abruft, tut er das oft in einem extrem engen Zeitfenster. Antwortet dein Server zu langsam, bricht die KI den Vorgang ab und zieht die Information von einer schnelleren Konkurrenzseite.

- Tipp: Optimiere deine Ladezeiten. Deine Seite muss sofort „da“ sein, damit sie im Moment der Antwort-Generierung berücksichtigt wird. Einen guten Einstieg bieten die Core Web Vitals.

- Thematische Relevanz (Vector Embeddings)

- Früher reichte es, Keywords zu streuen. Heute müssen Texte vor allem eine klare thematische Schärfe besitzen. KI-Modelle arbeiten mit sogenannten Vector Embeddings, mathematische Koordinaten, die Wörter und Inhalte in einem riesigen, mehrdimensionalen Bedeutungsraum verorten.

- Anstatt nur Buchstaben zu zählen, berechnet die KI die räumliche Nähe zwischen Begriffen: Je exakter ein Content ein Thema besetzt, desto klarer ist seine Position in diesem Raum. Werden zu viele Themen oberflächlich vermischt, „verwaschen“ diese Vektoren. Die Folge: Die KI kann die Seite keiner spezifischen Expertise mehr zuordnen und ignoriert sie bei gezielten Fachfragen.

Case Study: Was wir vom Claude-Leak lernen

Ein geleakter System-Prompt von Anthropic (Claude) zeigt die interne Logik: Die KI wird darin angewiesen, nur dann eine Websuche auszulösen, wenn die Anfrage hochaktuell, extrem spezifisch oder außerhalb des Standard-Wissens liegt.

Die Konsequenz für GEO: Wenn Content lediglich vorhandenes Wissen wiederkäut, wird das Modell keine Suche auslösen und dich folglich nicht zitieren. Sichtbarkeit erhält nur, wer Informationen liefert, die das Modell nicht bereits selbst weiß. Selbst wenn du einen Wissensvorsprung hast, heißt das nicht, dass die Modelle ihr Trainingswissen aktualisieren.

GEO vs. SEO: Warum die Trennung in die Irre führt

Oft wird GEO von Agenturen als Ablösung von SEO verstanden und kommuniziert. Tatsächlich ist SEO weiterhin das Fundament. Ohne technische SEO-Basics werden Inhalte nicht gecrawlt, ohne inhaltliche Tiefe werden sie nicht verstanden.

Allerdings gibt es eine kritische Herausforderung: Während gute SEO-Rankings Klicks bringen, können Zitate in KI-Antworten den Traffic für eine Website sogar deutlich senken. Wenn Google künftig immer mehr Fragen direkt beantwortet ohne Nutzer auf die Quellen der Informationen zu leiten, nützen Zitierungen nur noch wenn die Marke genannt wird.

Laut SISTRIX-Daten generiert Google im Schnitt rund 60 Prozent weniger Klicks für Quellen in AI Overviews. Erfolg muss daher neu definiert werden: Weg von der reinen Klick-Quantität, hin zur Qualität des Traffics und der Markenbindung. Wer seine Suche in LLMs beginnt, setzt sie möglicherweise in der klassischen Suche fort und kommt so über Umwege auf eine Website, um sich über die dort angebotenen Produkte und Lösungen aus erster Hand zu informieren. SEO rutscht also tiefer in den Marketing-Funnel, die erste Recherche zu einem Thema findet heute bereits häufig in LLMs statt und nicht mehr auf Webseiten.

Die ökonomische Realität von GEO: Welche Inhalte lohnen sich künftig noch?

Für Unternehmen stellt sich im Kern eine strategische Frage: Welche Art von Content erzeugt unter GEO-Bedingungen überhaupt noch wirtschaftlichen Mehrwert?

Klassischer SEO-Content war darauf ausgelegt, Informationsbedürfnisse abzudecken und dafür als Gegenleistung Klicks zu erhalten. In generativen Systemen funktioniert dieses Geschäftsmodell kaum noch. Wenn Google eine Frage direkt beantwortet, wird der Content zur Datenbasis, ohne Traffic zurückzugeben. Reine Ratgeber- oder Definitionsinhalte verlieren damit ihren Wert für den Ersteller, bleiben für Suchmaschinen-Rankings aber weiterhin essenziell.

Entscheidend ist daher nicht, ob Inhalte genutzt werden, sondern ob die eigene Marke in der Antwort sichtbar wird. Solche Nennungen entstehen, wenn drei Voraussetzungen erfüllt sind:

- Eindeutige fachliche Positionierung: Es muss klar erkennbar sein, wofür dein Unternehmen steht und in welchem konkreten Themen- oder Problemfeld es spezialisiert ist.

- Belastbare Inhalte: Deine Inhalte müssen diese Kompetenz nachvollziehbar belegen, durch Tiefe, konkrete Beispiele, Daten, Referenzen oder klare Anwendungsfälle.

- Externe Signale: Erwähnungen in Drittmedien, Bewertungen, Backlinks, Studien, Partnerschaften oder allgemeine thematische Autorität im Markt stärken die Wahrscheinlichkeit, dass deine Marke im passenden Kontext genannt wird.

Kurz gesagt: GEO funktioniert nur, wenn ein Unternehmen in einem klar umrissenen Kontext als naheliegende Lösung gilt. Sichtbar wird, wer sich fachlich eindeutig verortet und diese Position auch außerhalb der eigenen Website bestätigt bekommt. Hier unterscheiden sich GEO und SEO deutlich.

Rechtliche Dimension: Trainingsdaten und Opt-out

Die Debatte um GEO ist nicht nur technisch, sondern auch rechtlich relevant. KI-Anbieter stehen weltweit unter Beobachtung, wenn es um die Nutzung urheberrechtlich geschützter Inhalte als Trainingsdaten geht. Die bestehenden Gesetze waren auf die neue Technologie nicht vorbereitet und dadurch bisher kaum anwendbar.

Zwar können Website-Betreiber einzelne Bots wie den GPTBot über die robots.txt theoretisch aussperren (was Crawler allerdings ignorieren können), ein nachträglicher Einfluss auf bereits trainierte Modelle ist jedoch nicht möglich.

Das Blackbox-Problem: Unvorhersehbarkeit als Konstante

Ein fundamentales Problem für die strategische Planung von GEO bleibt die Undurchsichtigkeit der KI-Systeme. Wir befinden uns in einer Umgebung, die von außen nicht steuerbar ist. Es bleibt oft völlig unklar, ob eine KI eine Information aus ihren statischen Trainingsdaten generiert (Wissen, das fest im Modell „eingebacken“ ist) oder ob sie per RAG aktuell auf deine Webseite zugreift.

Ersteres kommt häufig bei Chatbots wie ChatGPT oder Gemini zum Tragen und lässt sich nachträglich nicht mehr beeinflussen. Letzteres unterliegt den tagesaktuellen Schwankungen des Algorithmus. Eine Antwort, die heute deine Marke prominent platziert, kann morgen durch ein Modell-Update oder eine minimale Änderung des Nutzer-Prompts komplett anders aussehen. Es gibt keine „festen Rankings“ mehr, nur noch temporäre Wahrscheinlichkeiten.

Der Paradigmenwechsel: Vom Ranking zur Empfehlung

Während SEO in „Listen“ denkt (Position 1 bis 10), denkt GEO in „Empfehlungen“. In einer KI-Antwort gibt es oft nur einen Gewinner.

- SEO: „Welche SEO-Agenturen gibt es in Berlin?“ (Liste mit Suchergebnissen).

- Heute: „Welche SEO-Agentur ist die beste?“ (KI selektiert und empfiehlt eine kleine Auswahl).

Erfolg im GEO-Zeitalter bedeutet daher nicht mehr nur, für einen Begriff gefunden zu werden, sondern der KI durch Daten, Expertise und externe Signale so viele Vertrauensbeweise zu liefern, dass sie deine Marke als die logische Lösung vorschlägt.

Warum SEO weiterhin unverzichtbar bleibt

Angesichts dieser Volatilität darf GEO also nicht die einzige Säule einer Digitalstrategie sein. Klassisches SEO wandelt sich unter diesen Bedingungen zum strategischen Sicherheitsnetz, allerdings unter geänderten Vorzeichen:

- Fokus auf Kern-Inhalte: Wenn der allgemeine Traffic durch KI-Antworten sinkt, ist es ökonomisch nicht mehr darstellbar, die gesamte Breite des Themenfeldes zu optimieren. SEO muss sich radikal auf die Inhalte konzentrieren, die am Ende der Customer Journey stehen, also dort, wo aus einem Nutzer ein Kunde wird.

- Autorität statt Masse: Da KI-Modelle zur Validierung ihrer Antworten bevorzugt auf die Top-Ergebnisse der organischen Suche zugreifen, bleibt ein starkes Ranking auf den vordersten Plätzen die einzige Eintrittskarte in die KI-Welt. Werbe-Blabla wird ausgefiltert; nur echte Expertise besteht den Qualitäts-Check der LLMs.

- Traffic: Selbst wenn sich der SEO-Traffic seit Einführung von Googles AI Overviews im Durchschnitt mehr als halbiert hat, bleibt dennoch noch viel Reichweiten-Potenzial zu bergen. Viele Menschen vertrauen KI-Antworten nicht und möchten lieber auf Originalseiten suchen oder sich orientieren, welche Inhalte es zu einem Thema gibt. Es gilt weiterhin: Ohne SEO kein nachhaltiger Traffic für Websites.

Strategische Roadmap: Von SEO zu GEO

Der Übergang zu GEO ist kein einmaliges technisches Update, sondern eine strategische Neuausrichtung. Um für die KI-Suche vorbereitet zu sein, müssen folgende Dinge kontinuierlich umgesetzt werden:

- Audit der technischen Barrieren:

- Robots.txt für GPTBot/CCBot prüfen.

- Server-Reaktionszeit (TTFB) unter 200ms optimieren.

- Schema.org Markup (JSON-LD) für Person, Organization und Product implementieren.

- Content-Upgrade auf „Information Gain“:

- Bestehende Texte um eigene Daten, Grafiken oder Expertenzitate ergänzen.

- „Synthetisierbarkeit“ prüfen: Sind die Fakten in Tabellen/Listen für KI leicht extrahierbar?

- Digital PR & Entity Building:

- Nennungen in autoritären Fachmedien forcieren (Trainingdata-Sicherung).

- Entitäten-Verknüpfung (z.B. Wikipedia-Einträge)

- Konsistenz der Firmendaten (NAP: Name, Address, Phone) über alle Plattformen hinweg.

Strategische Analyse statt Aktionismus

GEO ist kein kurzfristiger Hack, sondern eine ganzheitliche Disziplin. Statt mit massenhaft KI-generiertem Content schnelle Effekte erzwingen zu wollen, müssen Unternehmen systematisch messen, wie ihre Marke in Systemen wie Google AI Overviews oder ChatGPT stattfindet. Den passenden Einstieg liefert der AI-Actionplan für SEO und mehr Markenpräsenz.

Da der Platz in KI-Antworten begrenzt ist, entscheidet oft die wirtschaftliche Relevanz: Wo lohnt sich ein Investment in GEO-Content und wo sind Kanäle wie Newsletter oder Community strategisch stärker?

Entscheidend ist dabei die Erkenntnis, dass GEO über klassisches SEO (Technik und Content) hinausgeht. Während SEO die technische und inhaltliche Basis schafft, bewerten KI-Systeme Vertrauen primär über die reale Substanz eines Unternehmens: Markenreputation, PR-Präsenz und echte Kundenerfahrungen in Drittquellen. Das ist nicht auf Knopfdruck herstellbar, sondern erfordert Planbarkeit. Nachhaltige Sichtbarkeit ist kein technischer Trick, sondern das Ergebnis echter, kanalübergreifender Autorität.

SISTRIX kostenlos testen

- Kostenloser Testaccount für 14 Tage

- Unverbindlich, keine Kündigung notwendig

- Persönliches Onboarding durch Experten