Die Google Search Essentials (ehemalig Webmaster Guidelines) sind die Richtlinien, an die sich Webmaster laut Google halten sollen. Bei bewussten und unbewussten Verstößen kann es zu Rankingverlusten und Abstrafungen kommen.

- Was sind Googles Richtlinien für Webmaster?

- Warum benötigt Google Richtlinien?

- Was sind die allgemeinen Richtlinien von Google?

- Auffindbarkeit

- Verarbeitung

- Usability

- Was sind die Qualitätsrichtlinien?

- Automatisch generierte Inhalte

- Teilnahme an Linktauschprogrammen

- Erstellen von Seiten ohne oder mit nur wenigen eigenen Inhalten

- Cloaking

- Irreführende Weiterleitungen

- Verborgener Text/verborgene Links

- Brückenseiten

- Kopierte Inhalte

- Teilnahme an Affiliate-Programmen ohne ausreichenden Mehrwert

- Laden von Seiten mit irrelevanten Keywords

- Erstellen von Seiten mit schädlichen Funktionen

- Missbrauch von Rich-Snippet-Markup

- Senden von automatisierten Anfragen an Google

- Was kann ich tun, wenn ein Konkurrent gegen die Richtlinien verstößt?

- Was kann ich tun wenn ich selbst gegen die Richtlinen verstoßen habe?

- Fazit zu Googles Richtlinien für Webmaster

Was sind Googles Richtlinien für Webmaster?

Die Google Search Essentials sind allgemeine und spezifische Qualitäts-Richtlinien und sollen Webmastern ein Regelwerk an die Hand geben, wie die eigene Webseite strukturiert sein sollte und welche Praktiken Google nicht gerne sieht.

Warum benötigt Google Richtlinien?

Google hat sich selbst den Auftrag erteilt, das Wissen der Welt gebündelt verfügbar zu machen. Gleichzeitig hat sich Google jedoch auch als maßgeblicher Traffic-Lieferant und Gatekeeper des Webs etabliert. Eine Position, die dadurch erreicht wurde, dass Googles Ergebnisse relevanter und qualitativ hochwertiger sind als die anderer Suchmaschinen.

Damit das so bleibt unternimmt Google viel, um Täuschungsversuche, Manipulationen und Spam automatisiert zu erkennen und auszusortieren. Bei den Webmaster Guidelines handelt es sich um ein Regelwerk, das Webseitenbetreiber helfen soll, qualitativ hochwertige Webseiten anzubieten.

Die Webmaster Guidelines sind in zwei Teile unterteilt: die allgemeinen Richtlinien und die Qualitätsrichtlinien.

Was sind die allgemeinen Richtlinien von Google?

Im Teil der allgemeinen Richtlinien möchte Google Webmaster dafür sensibilisieren, wie sie Google beim Finden ihrer Seite unterstützen können (Auffindbarkeit), wie dem Googlebot das Verstehen der Seite leichter gemacht wird (Verarbeitung) und wie die Verwendung der Seite für Nutzer verbessert werden kann (Usability).

Auffindbarkeit

Damit Google selbstständig auf eine Webseite aufmerksam wird, muss diese über einen anderen Link einer bereits indexierten Webseite erreichbar sein. Auf der eigenen Webseite kann man dann noch Google unbekannte Unterseiten intern verlinken, im besten Fall mit einem möglichst relevanten Text als Linktext.

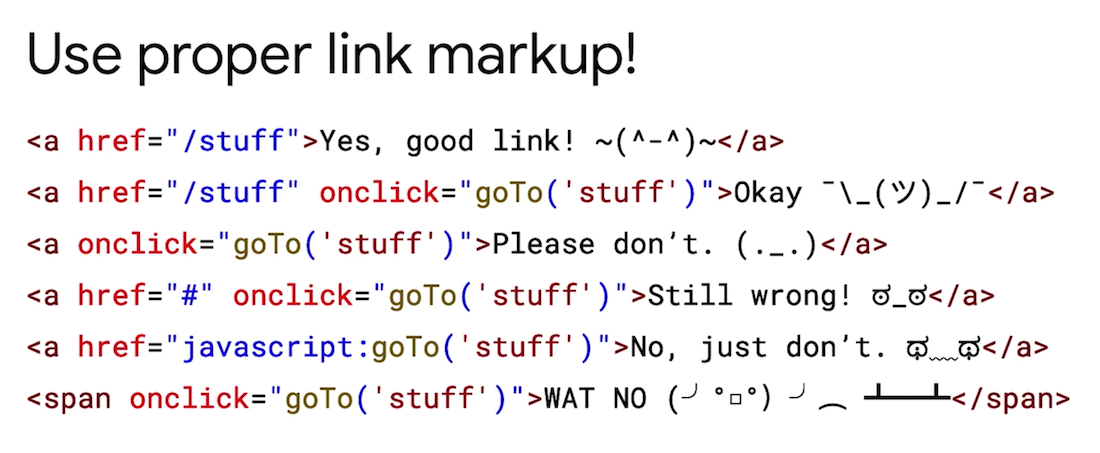

Bei Links ist es zudem wichtig, dass Google diese korrekt erkennt. Dazu gibt es ein Schaubild:

Zusätzlich kann die Indexierung einer Webseite auch manuell in der Google Search Console eingereicht werden. Damit Google einen besseren Überblick über die Seite erhält, wird angeraten, eine XML-Sitemap einzureichen.

Verarbeitung

Für Googles Indexierungsvorgang ist es wichtig, dass der Inhalt der eigenen Webseite klar und eindeutig formuliert ist sowie hilfreiche Informationen enthält.

Der Webseitenbetreiber sollte zudem sichergehen, dass alle relevanten Inhalte für den Nutzer sichtbar sind und diese nicht hinter weiteren Elementen versteckt werden, da diese von Google dann als weniger wertvoll erachtet werden können. In der Google Search Console gibt es zudem eine Einsicht über etwaige Probleme, die bei der Indexierung aufgetreten sind, die daraufhin gezielt behoben werden können.

Usability

Was die Usability angeht, wird angeraten, möglichst relevante Informationen bereit zu stellen sowie auf Schnelligkeit zu achten. Die Ladezeit ist ein erwiesener Qualitätsfaktor bezüglich der Usability. Google bietet dafür auch eigene Tools an, mit denen die Geschwindigkeit getestet werden kann.

Zudem ist es bei der steigenden Nutzung von mobilen Endgeräten unerlässlich, dass die eigene Webseite für alle Endgeräte optimiert ist – dies gilt besonders vor dem Hintergrund der Umstellung auf einen Mobile First Index. Darüber hinaus sollte die Webseite unter HTTPS abrufbar sein.

Was sind die Qualitätsrichtlinien?

In dem Abschnitt der Qualitätsrichtlinien sammelt Google Informationen zu Maßnahmen und Taktiken, die häufig zur Täuschung und Manipulation von Google genutzt werden und die Qualität der Suchergebnisse negativ beeinflussen.

Immer wenn die eigene Webseite plötzlich aufhört, teilweise oder komplett für vorher stabile Suchanfragen zu ranken, kann sich ein Blick in die Qualitätsrichtlinien lohnen.

Wir führen hier einige Punkte zusammen, die Google „nicht gerne sieht”.

Automatisch generierte Inhalte

Bei automatisch generierten Inhalten geht es Google um Texte, die von Programmen erstellt werden und keinerlei Mehrwert für menschliche Besucher mit sich bringen. Diese Texte lesen sich häufig so als ob sie von einem Drittklässler verfasst wurden.

Teilnahme an Linktauschprogrammen

Dieser Punkt ist auch heute noch aktuell. Hier geht es darum, Backlinks von anderen Seiten zu kaufen oder zu akquirieren, um das Vertrauen der eigenen Seite bei Google zu verbessern.

Gekaufte Links widersprechen Googles Richtlinien, da es relevante Inhalte sind, die sich Links verdienen sollen.

Um zu prüfen, wie qualitativ die Domains sind die auf die eigene Domain verlinken, bietet sich folgender Frag-SISTRIX-Beitrag an: Wie kann ich die Qualität einer potentiellen Backlinkseite bestimmen?

Erstellen von Seiten ohne oder mit nur wenigen eigenen Inhalten

Um die Suchintention zufriedenstellend zu bedienen, müssen Webseiten umfangreiche und wertvolle Inhalte bieten. Google nutzt neben einem Relevanz- auch einen Qualitätsfaktor für die interne Auswertung der Suchergebnisse. Das daraus entstandene Google Panda Update sorgt dafür, dass Seiten mit keinem oder nur sehr dünnen Inhalten nicht gut ranken.

Cloaking

Wenn der Googlebot andere Inhalte auf einer URL sieht als der Nutzer, heißt das Cloaking. Google ist es sehr wichtig, dass ein Nutzer die gesuchten Informationen auch tatsächlich auf der Seite findet.

Werden diese Informationen jedoch nur Google angezeigt – und normale Nutzer müssen sich z. B. erst anmelden oder für die Information zahlen – ist das Ergebnis für den Nutzer nicht zufriedenstellend.

Irreführende Weiterleitungen

Weiterleitungen, die auf URLs eingerichtet werden, die für ein bestimmtes Thema ranken, sollten auf passende Inhalte weiterleiten und nicht auf völlig themenfremde URLs.

Ein Beispiel: Wenn du auf ein Ergebnis in den Suchergebnissen zur Frage „Was sind die Google Webmaster Guidelines?“ klickst, möchtest du auf einer Seite zu genau diesem Thema landen und nicht auf kauf-dir-google-rankings.com/jetzt-kaufen.html.

Verborgener Text/verborgene Links

Bei verborgenen Texten oder Links ist es ähnlich wie beim Cloaking. Wenn Informationen auf der Webseite normalen Nutzer nicht ausgespielt werden, dem Googlebot aber schon, um Rankings zu erhalten. Dieses Vorgehen wird meistens dann genutzt, wenn man davon ausgeht bestimmte Worte und Sätze „für Google“ auf der Seite haben zu müssen, sich jedoch niemals trauen würde, diese Texte den eigenen Lesern zu zeigen. Oder man möchte Links auf der Webseite verkaufen, welche für die tatsächlichen Besucher unsichtbar sein sollen.

Hierzu werden dann die Texte oder Links zum Beispiel mit Hilfe von CSS so weit aus dem sichtbaren Bereich geschoben, dass sie selbst bei extrem großen Bildschirmen versteckt sind.

Auch hier gilt wieder die Devise: wenn es nur für Google dabei ist, ist es wahrscheinlich nicht hilfreich und kann unterlassen werden.

Brückenseiten

Bei Brückenseiten handelt es sich um Unterseiten auf der eigenen Domain (häufig auch externe Domains), die für bestimmte Keywords ranken sollen und dafür dem Googlebot ein zugeschnittenes Angebot ausliefern, den Nutzer jedoch auf eine ganz andere Seite weiterleiten.

Die Idee hinter Brückenseiten ist die, dass man mit verschiedenen Seiten oder Domains für ein Keyword oder eine Gruppe von Keywords mehrmals in den Suchergebnissen auftaucht und es somit wahrscheinlicher ist, dass ein Nutzer auf die gewünschte (Haupt-)Domain kommt. Dies gilt besonders für die erste Seite der Suchergebnisse, da dort der Großteil der Klicks stattfinden.

Brückenseiten waren zum Beispiel der Grund, warum BMW.de im Jahr 2006 manuell von Google aus dem Index geworfen wurde.

Kopierte Inhalte

Google möchte nicht, dass man sich mit der Arbeit von anderen schmückt und davon profitiert. Die Inhalte, die auf der eigenen Domain veröffentlicht werden, sollten niemals Plagiate sein.

Teilnahme an Affiliate-Programmen ohne ausreichenden Mehrwert

Diesen Punkt kann man sich als Zusammenschluss der Punkte Brückenseiten und wenige bis keinen Inhalt vorstellen. Wenn man eine eigene Affiliate-Seite aufbaut, diese jedoch nur mit Ressourcen befüllt, die vom Affiliate-Netzwerk vorgegeben sind, sieht Google darin möglicherweise ein Qualitätsproblem.

Einen Mehrwert definiert Google für Affiliate-Seiten dadurch, dass sie Inhalte anbieten, die es nicht überall sonst auch gibt. Dies können Rezensionen sein, selbst durchgeführte Tests und auch Seiten, die einen Überblick über die möglichen Produkte anbieten oder Preisvergleiche beinhalten.

Laden von Seiten mit irrelevanten Keywords

Die Rede ist von Seiten, die nur für Google erstellt wurden und auf denen sich nur Listen von Keywords befinden, die keinerlei Kontext zur restlichen Seite haben oder so häufig wiederholt werden, dass kein menschlicher Leser einen Mehrwert daraus zieht.

Erstellen von Seiten mit schädlichen Funktionen

Hier kommen wir in den Bereich der Black-Hat-Maßnahmen, die auf illegale Machenschaften abzielen, wie zum Beispiel das Ergaunern von Passworten (Phishing) oder das Installieren von Viren oder anderer Schadsoftware.

Häufig tritt dieses Problem bei gehackten Webseiten auf. Google informiert auf einer eigenen Seite darüber: Hilfe für Webmaster bei gehackten Websites.

Missbrauch von Rich-Snippet-Markup

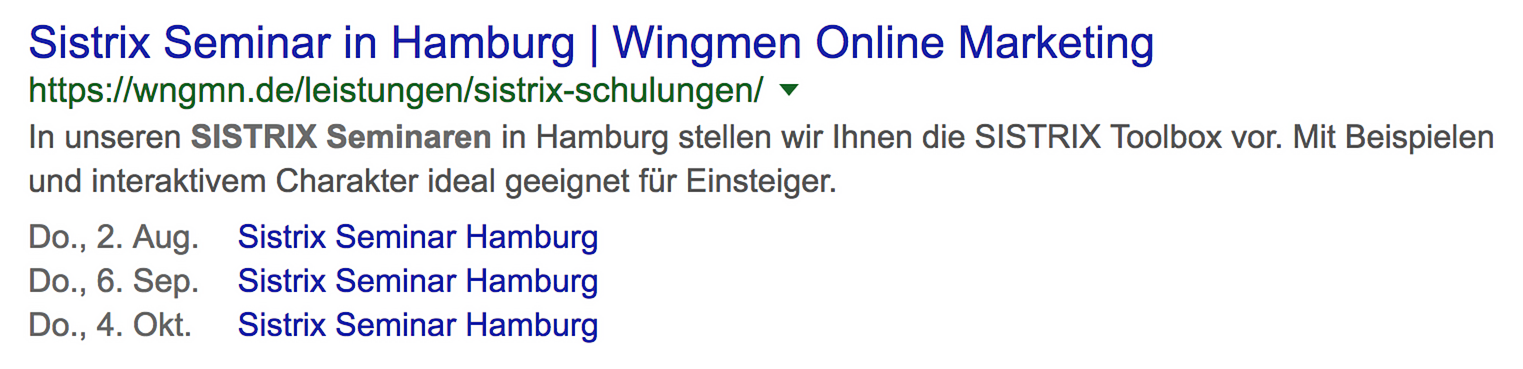

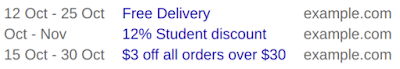

Rich Snippets werden von Google aus strukturierten Daten auf der Webseite erstellt. Rich Snippets können sein: Rezepte, Events und auch Sternebewertungen. Diese Rich Results nehmen einen gesonderten Platz im Suchergebnis (dem Snippet) ein. Für Google sollen entsprechende Snippets einen besonderen Mehrwert für den Suchenden darstellen.

Ein Beispiel: Unterhalb des Suchergebnisses werden in diesem Fall drei weitere Events angezeigt; dadurch verdoppelt sich die Interaktionsfläche in den Suchergebnissen nahezu.

Weil Rich Results ein starkes Alleinstellungsmerkmal besitzen, sind einige Webseitenbetreiber versucht, diese Funktion zu missbrauchen. So können mithilfe strukturierter Daten Events ausgezeichnet werden, die gar keine Events sind. Ein entsprechendes Beispiel hierfür zeigt Google im „Erinnerung zum Event-Markup„-Blogpost:

Senden von automatisierten Anfragen an Google

Für automatisierte Abfragen sollen die von Google angebotenen APIs genutzt werden anstatt programmatisch Informationen von Google zu scrapen.

Was kann ich tun, wenn ein Konkurrent gegen die Richtlinien verstößt?

Jeder kann einen Spamreport an Google senden. Hierbei ist es wichtig, die Verstöße der Richtlinien mit Beispielen zu belegen. Die Spamreports werden von Mitarbeitern des Google-Spam-Teams gelesen und evaluiert. Eine Rückmeldung auf einen Report erhält man nicht.

Es lohnt sich nicht, Spamreports mit vagen Vermutungen gegen einen Konkurrenten abzusenden. Wenn das Spam-Team feststellt, dass ein Report von geringer inhaltlicher Qualität ist, kann es passieren, dass zukünftige Reports vom gleichen Search-Console-Account ignoriert werden.

Was kann ich tun wenn ich selbst gegen die Richtlinen verstoßen habe?

Bei vielen Verstößen gegen die Google-Richtlinien kann die eigene Domain früher oder später von einer manuellen Maßnahme betroffen sein. In diesem Fall sendet Google eine Benachrichtigung durch die Google Search Console; Webmaster erhalten hier einen ersten Eindruck über das bestrafte Verhalten.

Ist dies geschehen kann man ein Reconsideration Request an Google senden. Das Spam-Team schaut sich dann die Webseite erneut an und tritt über den Request mit dem Webmaster in einen Dialog.

Fazit zu Googles Richtlinien für Webmaster

Es ist leicht zu verstehen, warum Google bestimmte Praktiken nicht gerne sieht. Webseiten, die nur dazu gedacht sind, Googles Ranking-Algorithmen zu täuschen oder gar Nutzern zu schaden sollen aus der Suche verbannt werden.

Wenn man sich als Webmaster darauf konzentriert, die eigenen Inhalte auf die eigene Zielgruppe auszurichten – und nicht auf Google -, gibt es nur sehr wenige Fälle, wie zum Beispiel Linktauschprogramme, in denen die Qualitätsrichtlinien für die eigene Seite zur Gefahr werden.