In diesem Beitrag fassen wir die wichtigsten Aussagen verschiedener Experten zum Thema Rankingfaktoren zusammen, die auch heute noch unverändert gültig sind und erweitern sie durch die wichtigsten Updates fürs Jahr 2026, die über Erfolg und Misserfolg entscheiden.

- 1. Das technische Fundament: Crawling und Indexierung

- 2. Page Experience: Das Zünglein an der Waage

- 3. Externe Links: Die Währung des Vertrauens

- 4. Die Architektur der Relevanz: Interne Verlinkung und Daten

- Strukturierte Daten (Schema.org)

- Rankings und Wettbewerb mit SISTRIX analysieren

- 5. E-E-A-T: Vertrauen und Identität

- 6. Content-Qualität: Suchintention und Holistik

- Datenbasierte Wettbewerbsanalyse mit SISTRIX

- 7. Nutzersignale: Zwischen Theorie und Praxis

- 8. Die Marke als Qualitätsfilter

- 9. Local SEO: Die Macht des Standorts

- 10. KI und LLMs: Die Zukunft der Suche

Im Jahr 2017 lud SISTRIX einige der prominentesten SEO-Experten des Landes, um im Rahmen der Reihe „SEO Talks” über Google Rankingfaktoren zu sprechen. Zwar hat sich die Suche seitdem technologisch massiv weiterentwickelt, die Grundlagen der Suchmaschinenoptimierung bleiben aber dieselben. Wer nachhaltig sichtbar werden will, muss die Mechanik hinter dem Crawling, der Autorität und der Nutzerführung beherrschen.

1. Das technische Fundament: Crawling und Indexierung

Bevor ein Dokument ranken kann, muss es von der Maschine effizient erschlossen werden. Dieser Prozess besteht aus drei Kernaufgaben: Erschließen (Crawling), Sortieren (Indexing) und Interpretieren (Ranking). Da das Web sekündlich um Millionen von Seiten wächst, ist das „Crawl-Budget“ eine endliche Ressource. Google muss entscheiden, welche Inhalte es wert sind, im Index behalten zu werden.

„Im Wesentlichen funktioniert die Google-Suche wie jede andere Suche auch: Ich muss zunächst einen Suchindex aufbauen […] das mache ich mit einem Crawler. […] Für das eigentliche Ranking nachher geht es um inhaltliche Relevanz, um irgendwelche User-Faktoren und um Freshness.“

— Tobias Schwarz (Geschäftsführender Gesellschafter, Audisto GmbH)

Ein modernes Ranking ist dabei keine statische Checkliste mehr. Algorithmen agieren parallel und gewichten Signale je nach Branche völlig unterschiedlich und stark dynamisch. In hochkomplexen Umgebungen ist es oft selbst für Experten schwer, den exakten Ausschlag für eine Positionierung zu isolieren.

„Google sagt ja auch selber, sie können heute gar nicht mehr nachvollziehen, warum ein Ergebnis jetzt auf 1 oder 2 oder 3 rankt, weil es einfach so komplex geworden ist […]. Keiner kann mehr nachvollziehen, warum letztendlich ein bestimmtes Ergebnis oben steht.“

— Prof. Dr. Mario Fischer (Studiengangsleiter E-Commerce, Hochschule Würzburg-Schweinfurt)

Jens Fauldrath vergleicht diesen Prozess mit einer gut geführten Bibliothek, in der der Bibliothekar die unpräzisen Fragen der Besucher übersetzen muss:

„Das sind die drei Kernaufgaben, die eine Suchmaschine erfüllt: zu erschließen, was ist bei mir drin? Wie ist es sortiert? Und wie habe ich Fragen zu interpretieren? Der Bibliothekar übersetzt das in seinem Kopf […] und läuft los und sagt ihm: Drittes Regal, zweites Fach in der Ecke findest du den Kram.“

— Jens Fauldrath (Geschäftsführer, get:traction GmbH)

Zusätzlich entscheidet heute auch maßgeblich die Aktualität über Rankings, schließlich sucht niemand nach veralteten Informationen.

2. Page Experience: Das Zünglein an der Waage

Ergänzend zur reinen Indexierung bewertet Google die technische Qualität der Nutzererfahrung. Wichtig ist hier die korrekte strategische Einordnung: Laut offiziellen Dokumentationen der Google Search Central ist die Page Experience ein wichtiges Signal, aber selten allein ausschlaggebend. Wenn zwei Seiten inhaltlich nahezu identisch an der Spitze konkurrieren, dient die technische Performance als „Tie-Breaker“ (das Zünglein an der Waage). Die Core Web Vitals liefern hierfür die harten Messwerte:

- LCP (Largest Contentful Paint): Misst die Ladezeit des Hauptinhalts (Zielwert: unter 2,5 Sekunden).

- CLS (Cumulative Layout Shift): Misst die visuelle Stabilität. Inhalte dürfen sich während des Ladens nicht unvorhersehbar verschieben.

- INP (Interaction to Next Paint): Misst die Reaktionsgeschwindigkeit der Seite auf Nutzerinteraktionen wie Klicks oder Eingaben.

Trotz dieser technischen Messbarkeit bleibt die offizielle Google-Doktrin bestehen: Ein hervorragendes Nutzererlebnis wiegt eine mangelnde inhaltliche Relevanz nicht auf. Die Passgenauigkeit des Inhalts zur Suchintention bleibt der dominante Faktor für das Ranking.

3. Externe Links: Die Währung des Vertrauens

Backlinks fungieren als digitales Empfehlungsschreiben. Google erkennt heute problemlos, ob ein Link aus einer echten redaktionellen Empfehlung und von einer seriösen Quelle stammt. Marcus Tandler prognostizierte bereits früh den Wandel weg von der reinen Verlinkung hin zum Nutzersignal:

„Am Ende des Tages entscheidet dann immer noch der User, was das beste Resultat ist. Links sind absolut unerlässlich […] aber im Bezug auf das Ranking wird der Impact, glaube ich, immer weniger werden, weil hier einfach der User das viel bessere Signal ist.“

— Marcus Tandler (Gründer & Geschäftsführer, Ryte)

Wer versucht, diesen Prozess durch massiven Linkkauf zu beschleunigen, geht laut Mario Fischer ein existenzielles Risiko ein:

„Das ist, als ob man auf dem Hockenheimring an der Steilkurve oben nur auf zwei Rädern die Steilkurve entlang fährt. Und das geht fünf Mal gut, aber beim sechsten Mal kracht es halt so furchtbar. Und wenn es dann halt ein komplettes Business wegreißt…“

— Prof. Dr. Mario Fischer (Studiengangsleiter E-Commerce, Hochschule Würzburg-Schweinfurt)

Nicolas Sacotte unterstreicht dabei die Bedeutung des echten Traffics über Links: „Was macht der Besucher, wenn er den Link geklickt hat? Und kommen überhaupt Besucher über einen Link?“ (Nicolas Sacotte, Gründer & Berater, contentking.de).

Links haben also nur dann einen Wert, wenn sie als Empfehlung oder Quellenverweis fungieren, auf themenrelevanten Websites erfolgen und auch geklickt werden. Alles andere ist Manipulation und wird von Google heute einfach ignoriert. Linkkauf lohnt sich also in den meisten Fällen heute nicht mehr.

4. Die Architektur der Relevanz: Interne Verlinkung und Daten

Die interne Linkstruktur ist das mächtigste Werkzeug, das Betreiber einer Website zu 100 % selbst kontrollieren. Sie dient der Nutzerführung und beweist Google die Themen-Expertise durch „Siloing“.

„Das Schöne an dem internen Linkgraphen ist natürlich, dass ich den manipulieren kann wie ich möchte, ohne dass mir das auf die Füße fällt.“

— Tobias Schwarz (Geschäftsführender Gesellschafter, Audisto GmbH)

Jens Fauldrath betont, dass eine klare Benennung der Links die Nutzbarkeit massiv erhöht: „Ein Link soll beschreiben, wo ich hinkomme. Das hebt die Nutzbarkeit meiner Seite massiv an.“ Seine goldene Regel für die Navigation:

„Don’t make me think! Wenn ich an der Hauptnavigation meine interne Organisation erkennen kann, dann ist sie immer falsch.“

— Jens Fauldrath (Geschäftsführer, get:traction GmbH)

Strukturierte Daten (Schema.org)

Um der Maschine die Arbeit zu erleichtern, sollten zudem Strukturierte Daten genutzt werden. Diese Codeschnipsel helfen Google, Informationen wie Preise oder FAQs maschinenlesbar auszuwerten und eine Seite besser zu verstehen.

Rankings und Wettbewerb mit SISTRIX analysieren

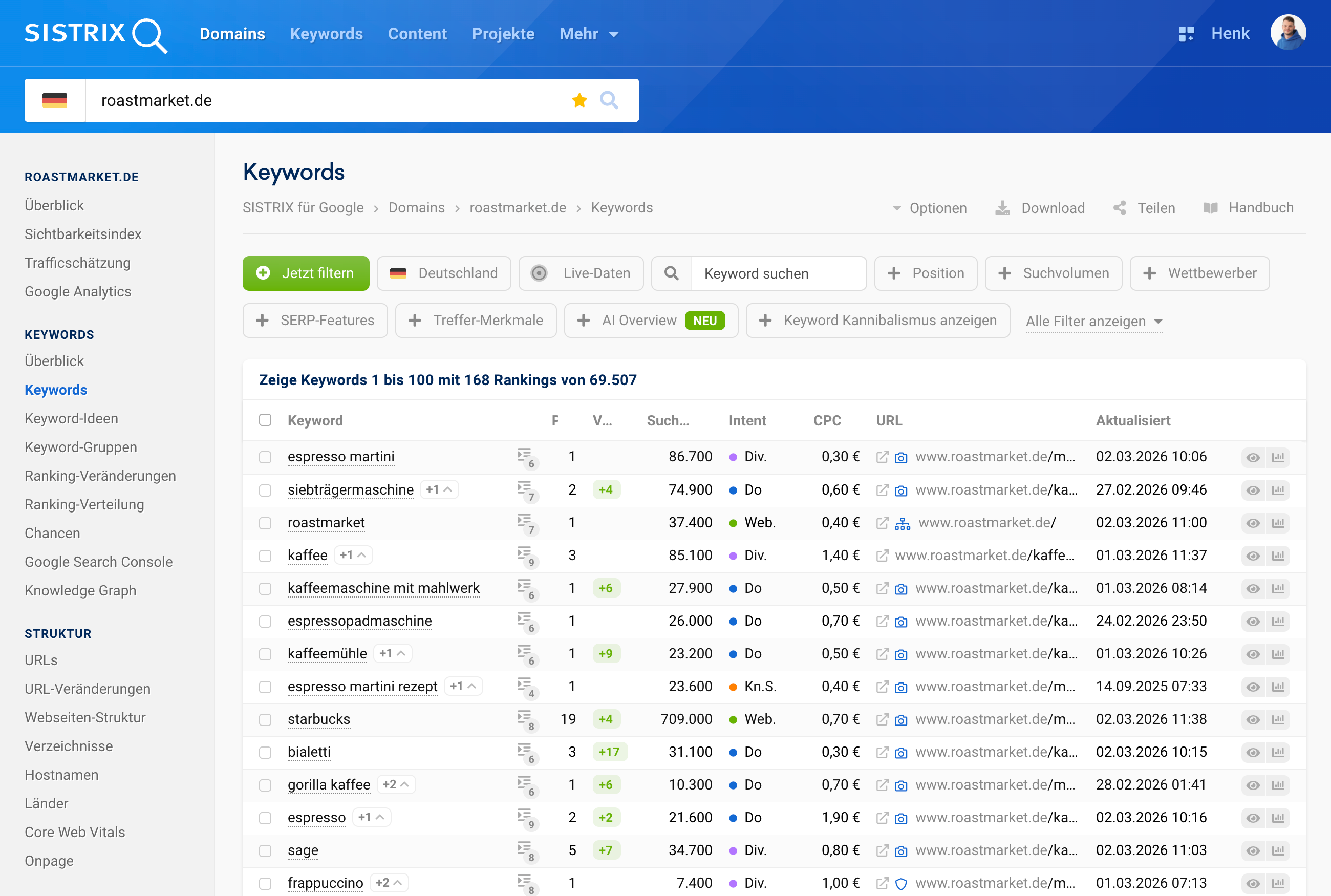

Wer SEO professionell betreibt, kommt an einer fundierten Ranking-Analyse nicht vorbei. Mit SISTRIX lässt sich die Sichtbarkeit jeder Domain präzise messen und mit dem Wettbewerb vergleichen. Das Tool zeigt auf einen Blick, für welche Keywords eine Website rankt, auf welchen Positionen sie steht und wie sich diese Rankings im Zeitverlauf entwickeln.

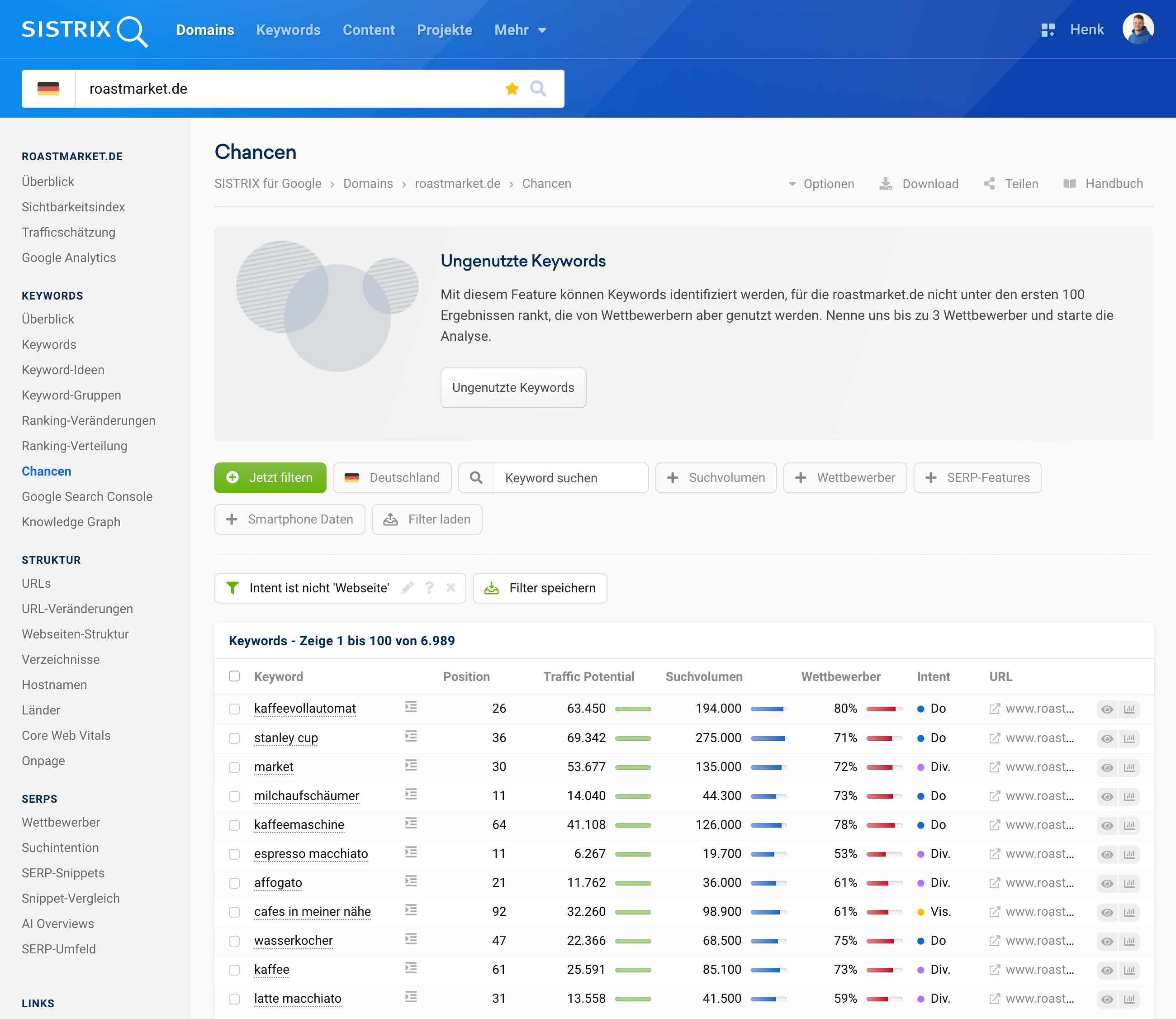

Besonders wertvoll: Die Keyword-Chancen-Funktion identifiziert Suchbegriffe, bei denen die eigene Seite knapp außerhalb der Top 10 rankt (Position 11-20) – hier liegt das größte Optimierungspotenzial, denn nur auf Seite 1 gibt es relevante Klicks.

Gleichzeitig deckt die Wettbewerbsanalyse auf, für welche Keywords Konkurrenten bereits erfolgreich ranken und welche Keyword-Überschneidungen bestehen. So lassen sich gezielt Content-Lücken schließen und strategische Entscheidungen datenbasiert treffen. Teste SISTRIX 14 Tage kostenlos und triff strategische Entscheidungen auf Basis echter Daten.

5. E-E-A-T: Vertrauen und Identität

Google bewertet heute nach dem E-E-A-T-Prinzip: Experience (Erfahrung), Expertise, Authoritativeness (Autorität) und Trustworthiness (Vertrauenswürdigkeit). Besonders bei YMYL-Themen („Your Money, Your Life“), also Inhalten zu Finanzen oder Gesundheit, achtet Google laut Sebastian Erlhofer massiv auf diese Signale:

„Your Money Your Life-Seiten […], da achtet Google viel stärker darauf. Das heißt, da werden bestimmte Rankingfaktoren, gerade die im Vertrauensbereich, noch viel stärker und anders gewichtet.“

— Sebastian Erlhofer (Gründer & Geschäftsführer, mindshape GmbH)

Anke Probst verbindet diese Qualität direkt mit der Nutzerabsicht: „Ich muss die User-Intention abfangen […]. Content sollte auf jeden Fall unique sein. Das ist selbstverständlich.“ (Anke Probst, Senior SEO Managerin, XING AG).

Uniqueness reicht bei der Masse der verfügbaren Inhalte zu jedem Thema allerdings auch nicht mehr aus, heute muss jeder neue Inhalt einen Mehrwert liefern in Form eines Informationsgewinns. Nur dann lohnt es sich, einen Text zu veröffentlichen. Was künftig von Suchmaschinen nicht mehr gebraucht wird sind Inhalte, die LLMs 100% fehlerfrei beantworten können (einfache Definitionen, Glossare, Zusammenfassungen,…). Woran viele LLMs noch scheitern ist Aktualität: häufig werden veraltete Informationen aus Trainingsdaten genannt, ohne Abgleich mit der aktuellen Datenlage. Und hier gibt es eine Chance für Webseiten, sich in ihrem Themengebiet positiv von der Masse veralteter Inhalte abzuheben und damit ihre Relevanz und Vertrauenswürdigkeit zu untermauern.

6. Content-Qualität: Suchintention und Holistik

Im modernen SEO entscheidet nicht mehr die „Keyword-Dichte”, also wie häufig ein Keyword verwendet wird, sondern die Relevanz für das Nutzerproblem. Ein Text muss „holistisch“ sein, er sollte alle relevanten Fragen beantworten, ohne dass Nutzer zur Suche zurückkehren müssen.

„Das Wichtigste, worauf man sich dann doch fokussieren sollte, ist der Inhalt und vor allem der Mehrwert des Inhaltes. Wenn ich den nicht habe, dann brauche ich im Grunde genommen auch kein SEO.“

— Raphael Raue (Head of SEO & Analytics, Spiegel Online)

Markus Hövener beschreibt den Wandel hin zu großen Themen-Hubs: „Früher war es so: Wenn du 100 Keywords hattest, hast du 100 Seiten dafür gemacht. […] Wo du früher viele kleine Seiten gemacht hast, machst du heute eine große Seite.“ (Markus Hövener, Head of SEO, Bloofusion).

Dabei gilt im Wettbewerb ein einfaches Prinzip des Benchmarkings:

„Ich muss eigentlich nur einen Tick besser sein als der Mitbewerber. Ich brauche auch keine 5.000 Worte. Es reicht mir, wenn ich schneller rennen kann als du.“

— Prof. Dr. Mario Fischer (Studiengangsleiter E-Commerce, Hochschule Würzburg-Schweinfurt)

Allerdings hat im KI-Zeitalter der Wettbewerb um Rankings stark zugenommen, es geht also immer draum, die bestmögliche Antwort zu bieten: besser als alles andere, was bereits im Netz zu finden ist. Nur dann gibt es noch eine Chance unter tausenden Beiträgen in den Top 10 der Google Rankings zu landen. Und nur dort gibt es Klicks.

Datenbasierte Wettbewerbsanalyse mit SISTRIX

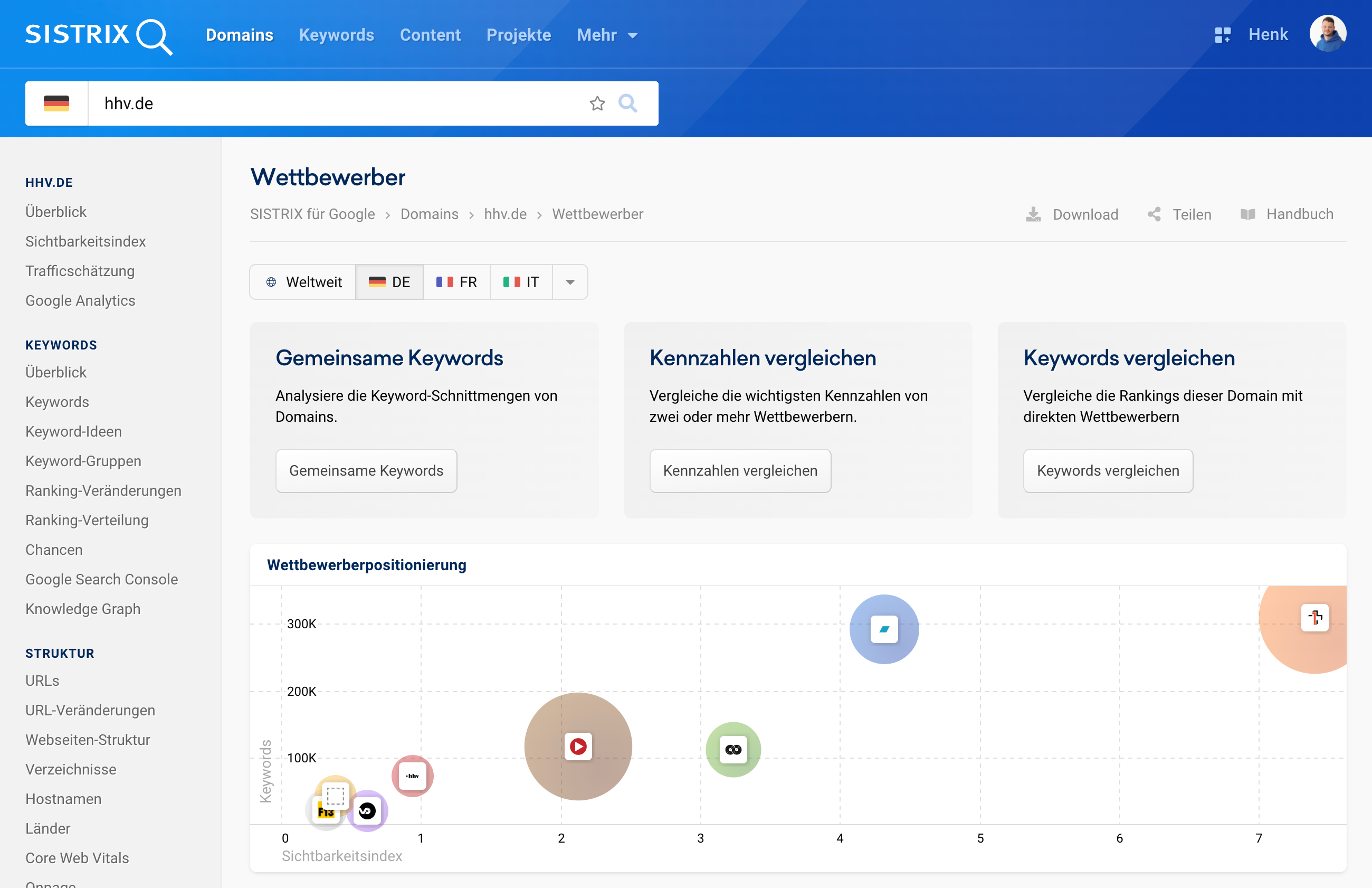

Mit Tools wie SISTRIX lässt sich dieser Wettbewerb konkret messbar machen: Die Funktion „Wettbewerber“ zeigt, welche Domains für ähnliche Keywords ranken und gibt Aufschluss über erfolgreiche Content-Formate der Konkurrenz.

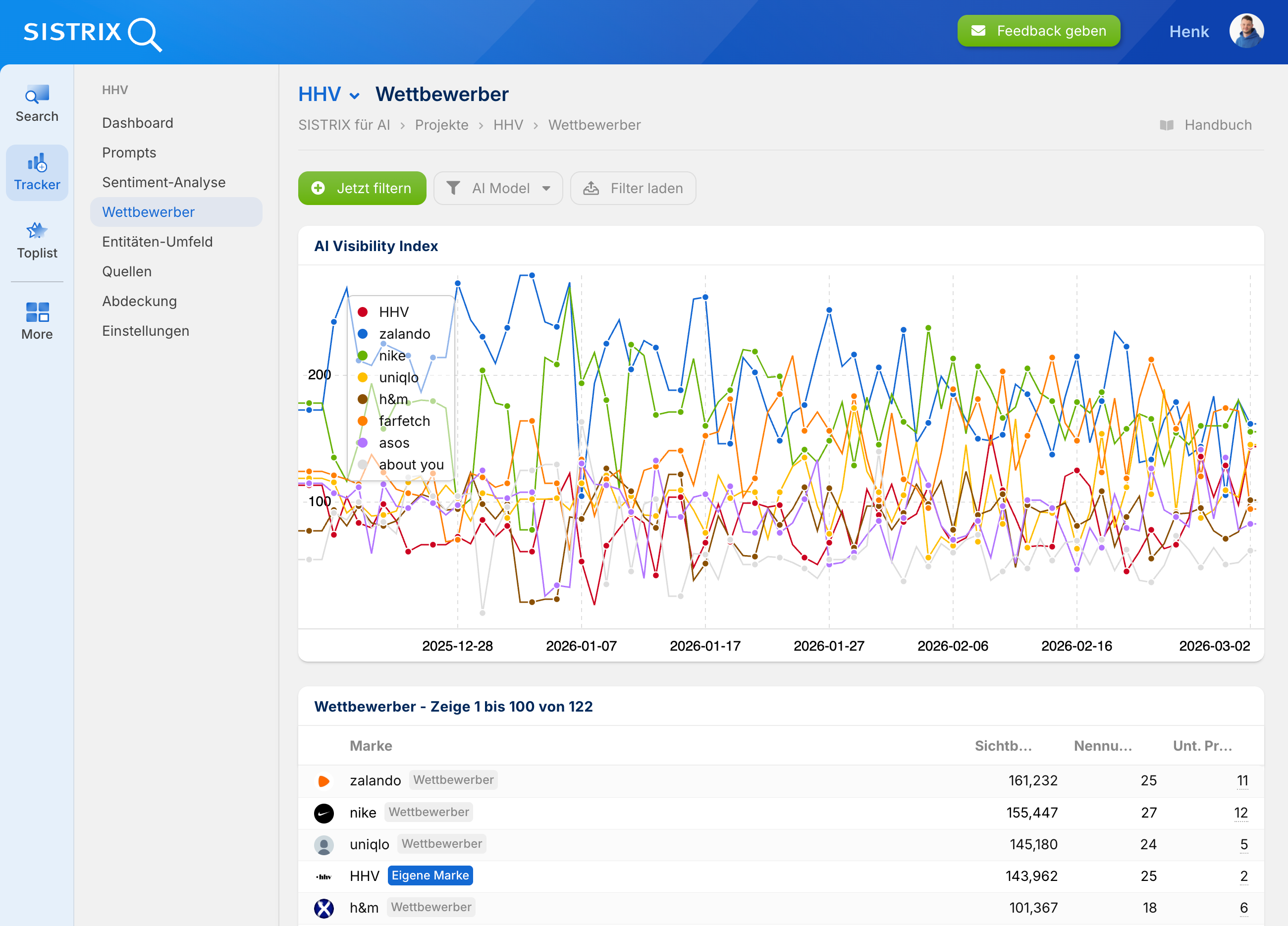

Diese Analyse funktioniert heute nicht mehr nur für die klassische Google-Suche, sondern auch für KI-Systeme. Mit dem LLM Tracking können selbst definierte Prompts überwacht werden, um zu messen, bei welchen Fragen eine Marke oder Website in den KI-Antworten genannt wird und welche Konkurrenten ebenfalls oder stattdessen auftauchen.

So lässt sich die Wettbewerbsanalyse auch auf die neuen Suchsysteme erweitern, bei denen klassische Rankings keine Rolle mehr spielen, sondern nur noch die Nennung als Quelle zählt. Wer systematisch analysiert, welche Seiten bereits in den Top 10 stehen und warum oder welche Inhalte von LLMs zitiert werden, kann gezielt bessere Inhalte erstellen. Nicht durch Raten, sondern durch datenbasierte Benchmarks.

7. Nutzersignale: Zwischen Theorie und Praxis

Das Thema Nutzersignale ist eines der umstrittensten Felder der Suchmaschinenoptimierung. Offiziell erklärt Google seit Jahren, dass direkte Metriken wie die Verweildauer oder die Bounce Rate nicht unmittelbar als Rankingfaktoren genutzt werden. Allerdings deuten Informationen aus dem umfangreichen Google-Leak vom Mai 2024 darauf hin, dass Klick-Daten und aggregierte Nutzerinteraktionen (beispielsweise über Systeme wie „NavBoost“) sehr wohl eine zentrale Rolle bei der Bewertung der Relevanz spielen können, auch wenn Google ungern darüber spricht.

Sebastian Erlhofer sieht diese Signale vor allem als Validierungsinstrument für den Algorithmus:

„Vielleicht gar nicht als primärer Rankingfaktor, aber zumindest für die ganzen Tests, die Google macht. Um zu schauen: Funktioniert das, was sie über andere Faktoren bewertet haben, dann auch bei den Nutzern?“

— Sebastian Erlhofer (Gründer & Geschäftsführer, mindshape GmbH)

Marcus Tandler ergänzt, dass Google Suchbegriffe im Snippet fett markiert, was die Klickrate (CTR) beeinflusst und somit die Aufmerksamkeit steuert. Wer Nutzer enttäuscht, wird langfristig Sichtbarkeit verlieren, da Google genügend Daten vorliegen, um das granular messen zu können. Die Relevanzbewertung erfolgt heute über gewaltige Datenmengen, mit denen Google die Qualität von Webseiten im direkten Vergleich zum Wettbewerb prüft. Deshalb macht es heute auch nur noch wenig Sinn, Suchergebnisse manipulieren zu wollen. Stattdessen sollten sich Seitenbetreiber fragen, welcher Content die Google-Suche für Menschen tatsächlich verbessert.

Beispiel: Wenn nur ein allgemeiner Wikipedia-Artikel zum Spezialgebiet eines Anbieters rankt, lohnt es sich, einen Expertenbeitrag zu erstellen, der die Suche besser und konkreter beantworten kann als ein länglicher Wikipedia-Eintrag.

8. Die Marke als Qualitätsfilter

Marken sind der effektivste Filter gegen minderwertigen Content. Johannes Beus erinnert an ein zentrales Zitat:

„Das Internet ist eine Klärgrube und Brands oder Marken sind die Lösung für dieses Problem. Wir müssen über Marken versuchen, dieses Internet zu filtern.“

— Johannes Beus (Gründer & Geschäftsführer, SISTRIX) unter Bezugnahme auf Eric Schmidt.

Marken haben den sogenannten „Brand Bonus“. Wenn Nutzer gezielt nach „Zalando Schuhe“ suchen, wird die Marke zum Category-Killer. Astrid Kramer weist darauf hin, dass Brands oft mehr Fehler verzeihen können: „Wenn ich BMW suche, will ich BMW finden. […] Dann interessiert es den Nutzer nicht, ob BMW das jetzt vollgespammt hat.“ (Astrid Kramer, Geschäftsführende Gesellschafterin, jacobi&jacobi GmbH).

Auch für Nennungen in KI-Antworten wird der Brand immer wichtiger: nur wer in seiner Branche einen herausragenden Ruf hat, wird in KI-Antworten auch als Marke genannt.

9. Local SEO: Die Macht des Standorts

Für lokale Unternehmen ist die räumliche Nähe oft der entscheidende Faktor. Google personalisiert Ergebnisse basierend auf dem Nutzerstandort. Hier zählen die Vollständigkeit des Google Unternehmensprofils und die Konsistenz von Name, Adresse und Telefonnummer (NAP), sowie Rezensionen. Lokale Relevanz schlägt hier oft globale Autorität. Wer nur lokal agiert (etwa in einem Ladengeschäft oder einem Restaurant), sollte sich voll und ganz auf die lokale Suche fokussieren, alles andere spielt dafür keine Rolle.

10. KI und LLMs: Die Zukunft der Suche

Heute beantwortet Google viele Suchanfragen direkt mit Hilfe von Large Language Models (LLMs) wie Gemini und spielt sie als AI Overviews vor den Suchergebnissen aus. Dadurch gibt es zwar weniger Reichweite für Webseiten, Rankings bleiben dennoch essenziell, da LLMs den Google-Index als Feed nutzen.

„Wir müssen nicht nur an Google denken, sondern eigentlich an den User. Und je besser Google den Job macht, umso besser geht dieser Fit.“

— Prof. Dr. Mario Fischer (Studiengangsleiter E-Commerce, Hochschule Würzburg-Schweinfurt)

Jens Fauldrath sieht in KI-Systemen einen Schritt zum besseren Verständnis der Intention: „Es geht darum, die Intention und nicht die Tokens zu suchen.“ Nachhaltiges SEO bedeutet heute, Inhalte so substanziell zu gestalten, dass eine KI sie als Quelle zitieren muss.

SEO im Jahr 2026 ist kein technisches Wettrüsten, sondern ein Wettbewerb um das beste Nutzererlebnis. Wer echten Mehrwert bietet, seine Marke pflegt und den Nutzer technisch versteht, nutzt das Google-Ranking als Hebel, um in der gesamten Informationswelt dauerhaft sichtbar zu bleiben.

„Unsere Aufgabe ist es, Suchmaschinennutzer zu Kunden zu machen. Es geht um den Menschen, der die Suchmaschine bedient.“

— Jens Fauldrath

Teilnehmer: Anke Probst, Astrid Kramer, Dominik Schwarz, Florian Stelzner, Hanns Kronenberg (Moderator), Jens Fauldrath, Jonas Weber, Johannes Beus, Marcus Tandler, Markus Hövener, Prof. Dr. Mario Fischer, Michael Janssen, Nicolas Sacotte, Raphael Raue, Sebastian Erlhofer, Simon Pokorny, Tobias Schwar

SISTRIX kostenlos testen

- Kostenloser Testaccount für 14 Tage

- Unverbindlich, keine Kündigung notwendig

- Persönliches Onboarding durch Experten